IA Generativa en la Investigación Académica Española: Estado del Arte 2026

La IA generativa en la investigación académica española ha experimentado una transformación sin precedentes en los últimos tres años. Lo que en 2022 era objeto de debate especulativo en seminarios de posgrado, en 2026 se ha convertido en una realidad cotidiana para más del 60% de los investigadores universitarios españoles, según datos del informe Stanford HAI AI Index 2025. Este artículo ofrece un estado del arte riguroso: qué está ocurriendo, cómo están respondiendo las instituciones y qué implicaciones tiene para la integridad y el futuro de la ciencia española.

La integración de modelos de lenguaje de gran escala —Large Language Models (LLMs) como GPT-4o, Claude 3.5 o Gemini 1.5— en flujos de trabajo investigadores plantea preguntas de calado metodológico y ético que ni la ANECA, ni el sistema universitario en su conjunto, han resuelto de forma definitiva. Este documento analiza el panorama actual, los marcos emergentes y las mejores prácticas adoptadas por las universidades líderes del EEES.

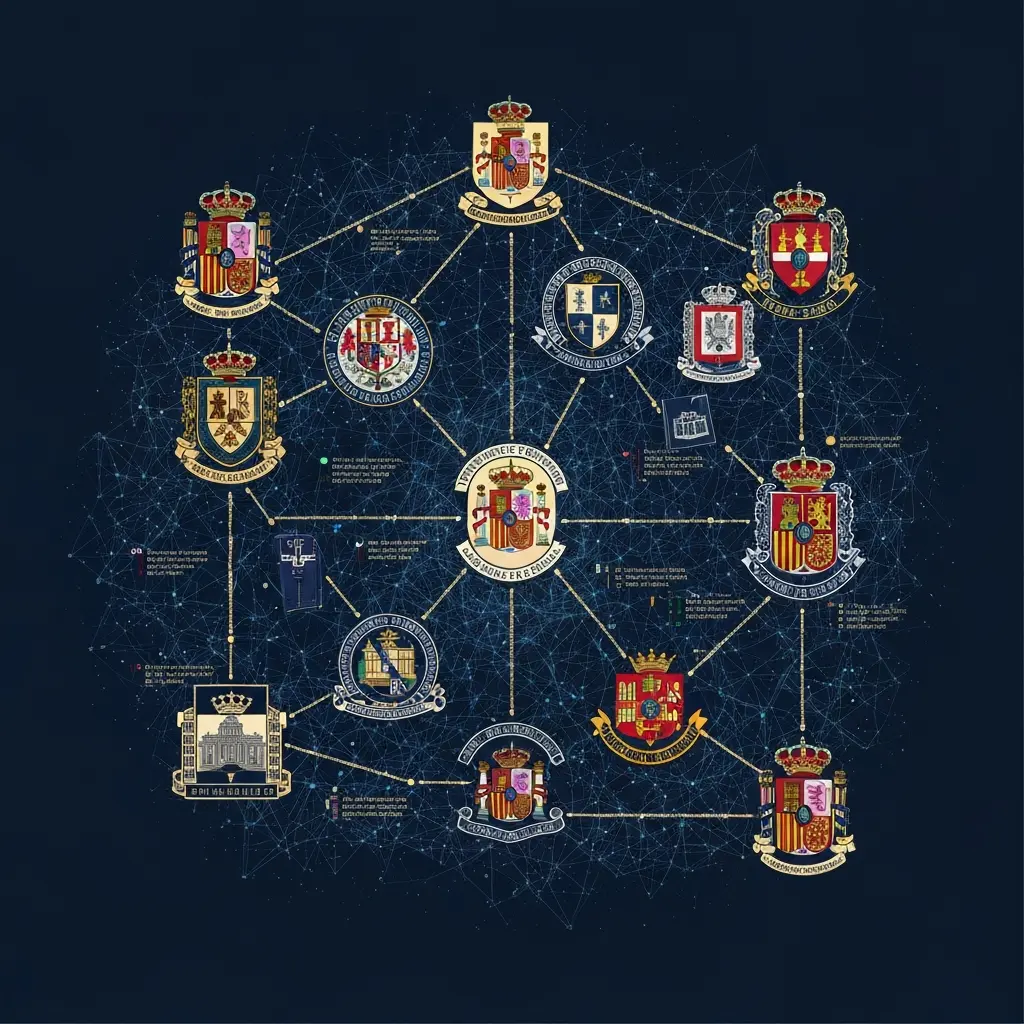

Adopción en el sistema universitario español

El sistema universitario español cuenta con 50 universidades públicas y 39 privadas, con más de 1,6 millones de estudiantes y aproximadamente 120.000 docentes-investigadores (Ministerio de Universidades, 2025). Dentro de este ecosistema, la penetración de la IA generativa ha sido rápida pero desigual.

Un estudio de la Universitat Oberta de Catalunya (UOC) publicado en RELIEVE (2025) señaló que el 63% de los doctorandos españoles había utilizado alguna herramienta de IA generativa durante la elaboración de su tesis, principalmente para revisión bibliográfica (78%), síntesis de literatura (65%) y corrección estilística (54%). Sin embargo, solo el 31% había declarado este uso explícitamente en su tesis, lo que evidencia una brecha entre práctica y transparencia.

Por tipo de institución, las universidades de investigación intensiva —Madrid, Barcelona, Valencia, Sevilla— muestran tasas de adopción superiores al 70%, mientras que las universidades docentes y de menor tamaño se sitúan en torno al 45-50%. Esta heterogeneidad dificulta la elaboración de políticas uniformes a escala nacional.

Datos clave de adopción (2026)

| Indicador | Dato | Fuente |

|---|---|---|

| Investigadores que usan IA regularmente | 63% | Stanford HAI, 2025 |

| Doctorandos que declaran uso de IA | 31% | UOC / RELIEVE, 2025 |

| Universidades con política de IA publicada | 38% | CRUE, 2025 |

| Revistas españolas con directrices sobre IA | 12% | SciELO / Redalyc, 2025 |

IA en cada fase del ciclo investigador

La integración de la IA generativa no es homogénea en todas las etapas del proceso investigador. Cada fase presenta usos consolidados y otros emergentes, con distintos niveles de aceptación metodológica.

1. Planteamiento y búsqueda bibliográfica

Las herramientas de búsqueda semántica asistida por IA —como Semantic Scholar, Elicit, Consensus o Research Rabbit— han transformado la revisión de literatura. Permiten identificar en minutos los artículos más relevantes de bases de datos como Scopus o Web of Science, sintetizar clusters temáticos y detectar brechas bibliográficas. ALEPH, el repositorio de acceso abierto de las universidades españolas, ha comenzado a integrar funcionalidades de IA para búsqueda semántica en 2025.

2. Diseño metodológico

Los asistentes de IA se usan crecientemente para diseño de instrumentos (guiones de entrevista, cuestionarios), validación de operacionalización de variables y cálculo de tamaño muestral. Sin embargo, esta fase requiere el mayor nivel de supervisión crítica, ya que las recomendaciones de la IA deben contrastarse con la literatura metodológica específica de cada disciplina.

3. Recogida y análisis de datos

En ciencias sociales y humanas, herramientas como Atlas.ti y NVivo han incorporado módulos de codificación asistida por IA que sugieren categorías emergentes durante el análisis temático. En ciencias experimentales, la IA se aplica en análisis de imágenes, procesamiento de señales y minería de texto. Véase el artículo sobre investigación cualitativa con asistencia de IA para un análisis detallado de estas técnicas.

4. Redacción y comunicación científica

La redacción asistida por IA para corrección estilística, adaptación a formato de revista y generación de abstracts en múltiples idiomas está normalizada en la comunidad investigadora. La controversia surge cuando la IA genera secciones sustantivas del texto sin suficiente supervisión, lo que plantea problemas de autoría y originalidad abordados en el marco ético para tesis doctorales.

Marco institucional: ANECA, CRUE y EEES

La Agencia Nacional de Evaluación de la Calidad y Acreditación (ANECA) no ha emitido aún una guía específica sobre IA en la actividad investigadora, aunque su programa ACADEMIA —para la acreditación del profesorado universitario— está revisando sus criterios de evaluación de la producción científica para contemplar el contexto de la IA generativa.

La CRUE Universidades Españolas publicó en 2024 el informe La Inteligencia Artificial Generativa en la Docencia Universitaria: Oportunidades, Desafíos y Recomendaciones, que establece tres principios orientadores: (1) uso crítico y supervisado, (2) transparencia y declaración de uso, y (3) preservación de la autonomía intelectual del investigador.

En el plano regulatorio, el Ministerio de Universidades negocia con la CRUE y las representaciones estudiantiles un Real Decreto que incluirá, por primera vez, un artículo específico sobre IA en la universidad. El decreto contemplaría la obligatoriedad de un código ético institucional para el uso académico e investigador de la IA, según declaraciones del propio Ministerio en abril de 2026 (El Debate, 2026).

En el contexto del Espacio Europeo de Educación Superior (EEES), la Declaración de Berlín 2003 y los estándares ESG 2015 no contemplan explícitamente la IA, pero la Comisión Europea trabaja en directrices específicas enmarcadas en la Estrategia Europea de IA. Puede consultarse el análisis de usos permitidos de IA en la universidad española 2026 para mayor detalle.

El Reglamento de IA de la UE (2024/1689) y la investigación académica

El Reglamento de Inteligencia Artificial de la Unión Europea (EU AI Act, Reglamento 2024/1689), publicado en el Diario Oficial el 12 de julio de 2024 y en aplicación progresiva hasta 2027, tiene implicaciones directas para la investigación académica:

- Artículo 2, apartado 6: Las actividades de investigación y desarrollo científico gozan de excepciones específicas, pero los sistemas de IA de alto riesgo utilizados en evaluación educativa no están exentos.

- Artículos 50 y 53: Establecen obligaciones de transparencia para modelos de IA de uso general (GPAI), relevantes para los LLMs usados en investigación.

- Considerando 23: Reconoce la necesidad de equilibrar la libre investigación con la gestión de riesgos sistémicos de los modelos fundacionales.

Las universidades españolas deberán adaptar sus protocolos de uso de IA a estas obligaciones de aquí a 2026-2027, especialmente en lo relativo a trazabilidad y documentación del uso de herramientas de IA en proyectos financiados con fondos públicos.

Impacto por área disciplinar

El impacto de la IA generativa varía sustancialmente según el área de conocimiento, condicionado por la naturaleza de los datos, los estándares metodológicos y la cultura disciplinar.

Ciencias sociales y humanas

Son las disciplinas con mayor controversia metodológica. El análisis de texto asistido por IA plantea preguntas sobre la interpretación hermenéutica, la posición del investigador y la validez constructivista. La OECD (2023) señalaba que las humanidades digitales son el área de mayor crecimiento en adopción de IA, pero también la de mayor riesgo para la integridad interpretativa.

Ciencias de la salud

La IA generativa se aplica en revisiones sistemáticas, análisis de registros clínicos y síntesis de evidencia. Las guías CONSORT y PRISMA han sido actualizadas para incluir declaraciones sobre IA. La EMA (Agencia Europea del Medicamento) ha publicado directrices específicas para el uso de IA en ensayos clínicos.

Ciencias experimentales e ingenierías

La generación asistida de código (GitHub Copilot, Claude Code) y el análisis automatizado de resultados experimentales están profundamente integrados. La reproducibilidad es el desafío clave, analizado en detalle en el artículo sobre reproducibilidad científica e IA generativa.

Integridad académica y trazabilidad

La integridad académica es el eje central del debate. Tres dimensiones merecen atención específica:

Autoría y contribución

El Comité Internacional de Editores de Revistas Médicas (ICMJE) estableció en 2023 que los sistemas de IA no pueden ser coautores de artículos científicos. Esta posición ha sido adoptada por la mayoría de las grandes editoriales (Elsevier, Springer, Wiley), que exigen la declaración explícita de uso de IA en el proceso de revisión. En España, el Consejo Superior de Investigaciones Científicas (CSIC) ha adoptado esta misma posición para sus revistas.

Declaración de uso

La Universidad Carlos III de Madrid fue pionera en España al exigir, desde el curso 2025-2026, que todas las tesis doctorales incluyan una «Declaración de Tecnologías de Asistencia» que especifique qué herramientas de IA se utilizaron, en qué fases y con qué supervisión. Este modelo está siendo adoptado por otras universidades del grupo Russell-equivalente español.

Detección y verificación

Las herramientas de detección de contenido generado por IA —GPTZero, Turnitin AI Detection, Copyleaks— presentan tasas de error que oscilan entre el 8% y el 23% (falsos positivos + falsos negativos), según estudios comparativos recientes. Esto hace que su uso como evidencia disciplinaria sea metodológicamente cuestionable. Las universidades españolas están implementando protocolos mixtos que combinan análisis computacional con entrevistas de comprensión al doctorando. Consulta también los datos estadísticos sobre IA en universidades españolas para más contexto.

Herramientas y plataformas más usadas en España en 2026

El ecosistema de herramientas de IA para investigación ha madurado considerablemente. Estas son las más utilizadas por los investigadores españoles:

- Búsqueda y síntesis bibliográfica: Elicit, Consensus, Semantic Scholar, Research Rabbit, Connected Papers

- Gestión de referencias: Zotero con plugins de IA, Mendeley con funciones de recomendación

- Análisis cualitativo: Atlas.ti (con IA integrada), NVivo 15, Dedoose

- Redacción y revisión: Claude (Anthropic), GPT-4o (OpenAI), Gemini (Google), Grammarly con IA

- Análisis estadístico asistido: JASP con IA, JMP Pro, Python/R con librerías de ML

- Plataformas académicas especializadas: Tesify (para escritura académica estructurada y gestión de citas APA/Vancouver/Chicago)

Perspectivas y retos 2026-2030

El horizonte a corto-medio plazo presenta cinco retos estructurales para el sistema de investigación español:

- Gobernanza multinivel: Articular coherentemente las regulaciones europeas (EU AI Act), nacionales (futuro Real Decreto) e institucionales sin generar fragmentación normativa.

- Brecha de competencias: La UNESCO (2023) estima que el 70% de los investigadores de países de renta media-alta no tienen formación formal en IA. La formación continua en IA para investigadores debe ser una prioridad estratégica de las universidades y la ANECA.

- Reproducibilidad y documentación: El desarrollo de estándares para la documentación del uso de IA en el proceso investigador (similar a los «datasheets for datasets») es urgente para mantener la reproducibilidad científica.

- Equidad y acceso: Los modelos de IA de última generación tienen costes que pueden crear desigualdades entre investigadores de universidades con diferente capacidad económica, replicando brechas ya existentes.

- Impacto en la formación doctoral: Redefinir qué competencias debe desarrollar un doctorando en un entorno de IA ubicua, manteniendo el foco en el pensamiento crítico, la originalidad interpretativa y la responsabilidad científica.

Herramientas como Tesify, diseñadas específicamente para el contexto académico, integran estas preocupaciones ofreciendo soporte estructurado a la escritura con plena trazabilidad del proceso y gestión de fuentes conforme a los principales estilos de citación.

Preguntas frecuentes

¿Qué porcentaje de investigadores españoles usa IA generativa en 2026?

Según el Stanford HAI AI Index 2025, aproximadamente el 63% de los investigadores universitarios españoles utiliza herramientas de IA generativa de forma regular en su trabajo académico, con variaciones significativas por disciplina y tipo de institución. Las universidades de investigación intensiva superan el 70% de adopción.

¿Qué dice la CRUE sobre el uso de IA en investigación?

La CRUE publicó en 2024 el informe «La IA Generativa en la Docencia Universitaria» con tres principios: uso crítico y supervisado, transparencia y declaración de uso, y preservación de la autonomía intelectual. Además, está negociando con el Ministerio de Universidades un Real Decreto que exigirá un código ético institucional obligatorio en todas las universidades.

¿Obliga el Reglamento de IA de la UE a declarar el uso de IA en investigación?

El Reglamento de IA de la UE (2024/1689) establece obligaciones de transparencia para modelos GPAI (artículos 50 y 53) y exime parcialmente la investigación científica, pero los sistemas de alto riesgo usados en evaluación educativa no están exentos. Las universidades deben adaptar sus protocolos a este marco de aquí a 2026-2027.

¿Puede la IA ser coautora de un artículo científico?

No. El ICMJE, las principales editoriales científicas y el CSIC en España establecen que los sistemas de IA no pueden figurar como coautores. La autoría implica responsabilidad intelectual y legal que solo pueden asumir personas físicas. El uso de IA en el proceso de elaboración debe declararse explícitamente, pero no confiere autoría.

¿Qué universidades españolas son pioneras en políticas de IA para investigación?

La Universidad Carlos III de Madrid fue pionera al exigir desde 2025-2026 una «Declaración de Tecnologías de Asistencia» en todas las tesis doctorales. La UNED ha publicado una guía completa para el uso académico de IA. La Universidad de Sevilla y la Autónoma de Barcelona también han desarrollado marcos institucionales propios.

¿Son fiables los detectores de IA para identificar texto generado en tesis?

No completamente. Los detectores actuales (Turnitin AI, GPTZero, Copyleaks) presentan tasas de error del 8-23%, incluyendo falsos positivos que pueden afectar injustamente a investigadores. Las universidades españolas están adoptando protocolos mixtos que combinan análisis computacional con entrevistas de comprensión, que son metodológicamente más robustos.

¿Cómo afecta la IA generativa a la reproducibilidad científica?

La IA generativa introduce nuevos desafíos para la reproducibilidad: los LLMs son no deterministas (respuestas distintas ante el mismo prompt), los modelos se actualizan sin versionado consistente, y la documentación del proceso de uso de IA suele ser insuficiente. Se recomienda documentar versión del modelo, prompts utilizados y fecha de consulta para garantizar la trazabilidad.

¿Existe formación específica en IA para investigadores en España?

La oferta formativa está creciendo rápidamente. El CSIC ofrece cursos de IA para investigadores; la UIMP, los cursos de verano sobre IA y ciencia. Las escuelas de doctorado están incorporando módulos de IA en sus programas de formación transversal. La UNESCO estima que aún el 70% de los investigadores en países similares a España carece de formación formal específica en IA.

Referencias

- Bommasani, R., et al. (2022). On the opportunities and risks of foundation models. arXiv preprint arXiv:2108.07258. Stanford Center for Research on Foundation Models.

- CRUE Universidades Españolas. (2024). La Inteligencia Artificial Generativa en la Docencia Universitaria: Oportunidades, desafíos y recomendaciones. CRUE.

- European Parliament & Council. (2024). Regulation (EU) 2024/1689 on Artificial Intelligence (EU AI Act). Official Journal of the European Union.

- Guersenzvaig, A., Sánchez-Monedero, J., Gopegui, B., & Picassó, M. (2024). Inteligencia artificial generativa en la educación universitaria: la urgencia de una perspectiva crítica. SSRN Working Paper. https://papers.ssrn.com/sol3/papers.cfm?abstract_id=5006444

- ICMJE. (2023). Recommendations for the conduct, reporting, editing, and publication of scholarly work in medical journals. International Committee of Medical Journal Editors.

- Ministerio de Universidades. (2025). Datos y cifras del sistema universitario español. Curso 2024-2025. Secretaría General de Universidades.

- OECD. (2023). OECD Digital Education Outlook 2023: Towards an Effective Digital Education Ecosystem. OECD Publishing. https://doi.org/10.1787/c74f03de-en

- Perkins, M., Roe, J., Postma, D., McGaughran, J., & Hickerson, D. (2024). Detection of GPT-4 generated text in higher education: Combining academic judgement and software to identify generative AI tool misuse. Journal of Academic Ethics, 22(1), 89-113.

- Salvagno, M., Taccone, F. S., & Gerli, A. G. (2023). Can artificial intelligence help for scientific writing? Critical Care, 27(1), 75. https://doi.org/10.1186/s13054-023-04380-2

- Stanford HAI. (2025). Artificial Intelligence Index Report 2025. Stanford University Human-Centered AI Institute.

- UNESCO. (2023). Guidance for Generative AI in Education and Research. UNESCO Publishing. https://unesdoc.unesco.org/ark:/48223/pf0000386693

- Weidinger, L., et al. (2022). Taxonomy of risks posed by language models. Proceedings of the 2022 ACM Conference on Fairness, Accountability, and Transparency, 214-229.

Deja una respuesta