Llevas 14 meses trabajando en tu tesis. Noches sin dormir, cientos de fuentes consultadas, reuniones interminables con tu director. El día de la defensa llega y todo parece ir bien… hasta que un miembro del tribunal hace esa pregunta: «¿Puedes explicarnos exactamente cómo utilizaste herramientas de inteligencia artificial en este trabajo?»

Tu corazón se detiene. No porque hayas hecho trampa, sino porque nunca pensaste que tenías que declararlo. Usaste ChatGPT para pulir algunos párrafos, para generar ideas cuando tenías bloqueo de escritor. Nada grave, ¿verdad?

Tres semanas después recibes la notificación: tesis suspendida por falta de transparencia en el uso de herramientas de IA. Catorce meses de trabajo, evaporados.

Este escenario, que hace dos años parecía ciencia ficción, se ha convertido en una realidad cada vez más frecuente en universidades españolas. Los casos disciplinarios relacionados con el uso indebido de IA en trabajos académicos se han incrementado significativamente desde 2024, y las sanciones van desde la repetición del trabajo hasta la expulsión temporal.

Y aquí está la parte que nadie te cuenta: la mayoría de estos estudiantes no tenían mala intención. Simplemente cometieron errores que desconocían que eran errores.

🚨 Los 5 errores de ética con IA que arruinan tesis en 2025:

- Ocultar el uso de IA al tribunal

- Atribuir autoría intelectual a la IA

- No verificar información generada

- Usar IA para evadir el proceso de aprendizaje

- Ignorar las políticas específicas de tu universidad

El uso ético de inteligencia artificial en tesis universitarias ya no es una recomendación bienintencionada. En 2025, es un requisito de supervivencia académica. Las reglas han cambiado, las herramientas de detección han evolucionado, y las universidades españolas han dejado de mirar hacia otro lado.

La buena noticia es que todos estos errores son completamente evitables. Vamos a analizar cada uno en profundidad, entender por qué ocurren, qué consecuencias tienen, y cómo protegerte de ellos.

¿Quieres empezar con una base sólida? Te recomiendo consultar nuestra Guía completa de uso ético de IA en trabajos académicos antes de continuar.

El Nuevo Paradigma: Por Qué las Reglas del Juego Cambiaron en 2025

Si hubieras presentado una tesis en 2022, probablemente nadie te habría preguntado si usaste inteligencia artificial. Hoy, es la primera pregunta que muchos tribunales tienen en mente.

En 2023, la mayoría de universidades españolas no tenían políticas específicas sobre IA en trabajos académicos. Los profesores improvisaban criterios. Algunos prohibían todo uso, otros lo ignoraban. Era el salvaje oeste de la inteligencia artificial académica.

En 2025, el panorama es radicalmente distinto. La mayoría de universidades han adoptado normativas específicas, los detectores de contenido generado por IA se han sofisticado enormemente, y los tribunales reciben formación específica para evaluar el uso ético de estas herramientas.

Las universidades españolas están adaptando sus políticas a marcos internacionales como la Recomendación de UNESCO sobre Ética de la IA, que establece principios de transparencia y responsabilidad que ahora permean en las políticas académicas.

Una de las justificaciones más comunes que escucho de estudiantes sancionados es: «Pero si todos mis compañeros lo hacen igual». La diferencia entre el estudiante que aprueba y el que suspende ya no está en si usa IA, sino en cómo la usa y cómo lo comunica.

Para profundizar en los mitos sobre porcentajes «permitidos» de IA en tesis, te recomiendo leer Límite de IA en Tesis 2025: Lo Que Nadie Te Cuenta.

Error #1 – Ocultar el Uso de IA al Tribunal

Este es, sin duda, el error más grave y el que más tesis ha arruinado en los últimos dos años. Lo paradójico es que muchos estudiantes ni siquiera saben que lo están cometiendo.

Hay tres razones principales por las que ocurre: el miedo a ser juzgado («si digo que usé IA, pensarán que no soy capaz»), la creencia del «si no preguntan, no digo», y el simple desconocimiento de que declarar el uso de IA es un requisito formal.

Lo entiendo perfectamente. Después de meses de trabajo, lo último que quieres es que alguien piense que tu esfuerzo no fue «real» porque usaste una herramienta. Pero ocultar información relevante al tribunal es una forma de deshonestidad académica, aunque no lo parezca.

Las consecuencias van mucho más allá de una mala nota: pérdida de confianza académica irreparable, anulación retroactiva de la tesis incluso después de aprobarla, y un precedente en tu expediente que puede afectar a futuras solicitudes de máster, doctorado o becas.

Los tribunales detectan inconsistencias estilísticas, cambios abruptos en el tono entre secciones, y especialmente cuando no puedes explicar decisiones metodológicas que están en tu propio texto durante la defensa oral.

Según las recomendaciones ICMJE sobre uso de IA por autores, existe una obligación explícita de informar sobre el uso de estas herramientas, manteniendo la responsabilidad humana sobre el contenido final.

El protocolo recomendado es simple: incluir una declaración en la sección de metodología, documentar los prompts y outputs relevantes, y comunicar proactivamente a tu director desde el principio. Para una guía completa, consulta nuestra Guía de Transparencia IA Académica 2025.

Error #2 – Atribuir Autoría Intelectual a la IA

Este error es más sutil pero igual de problemático. ¿Alguna vez has escrito algo como «según la inteligencia artificial utilizada…» como si fuera una fuente de autoridad? ¿Has dejado que ChatGPT decidiera la estructura de un capítulo sin cuestionarla?

Si la respuesta es sí, estás cometiendo este error.

Aquí está la verdad que nadie te dice de forma tan directa: la IA no piensa, procesa. No investiga, predice texto. Un modelo de lenguaje genera texto basándose en patrones estadísticos. No «sabe» nada. No «opina» nada. No tiene criterio.

Por eso, tú eres responsable de cada palabra, dato y conclusión que aparece en tu tesis. El tribunal no evalúa la capacidad de la IA. Te evalúa a ti.

Según las recomendaciones WAME, los chatbots no pueden figurar como autores de ninguna publicación académica porque no pueden asumir responsabilidad por el contenido.

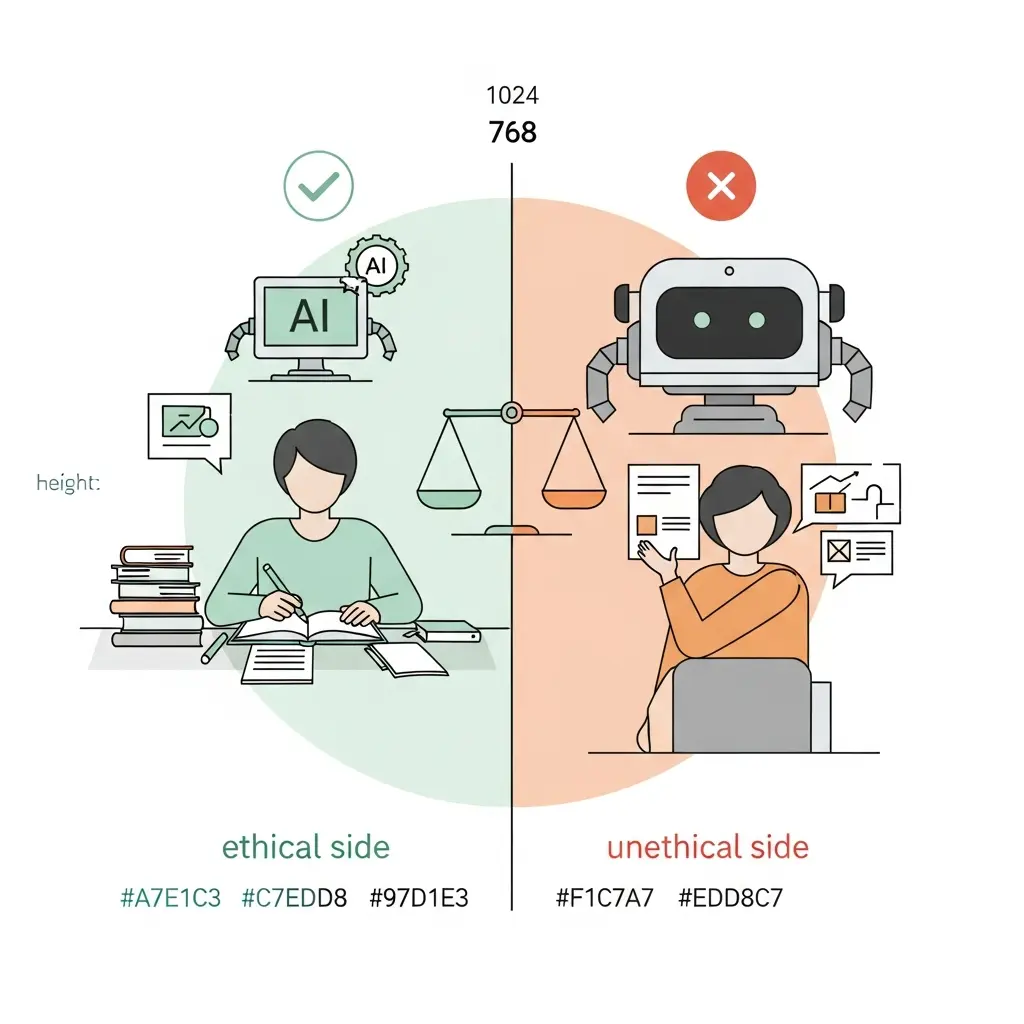

| ✅ Uso ético | ❌ Ceder autoría |

|---|---|

| IA para superar bloqueo de escritor | IA para escribir por ti |

| IA para explorar estructuras posibles | IA para decidir tu estructura |

| IA para revisar gramática | IA para «mejorar» tu argumento |

| IA como punto de partida para brainstorming | IA como fuente de conclusiones |

Para entender mejor qué usos están permitidos y cuáles no, te recomiendo leer Uso Permitido de ChatGPT en Tesis Académicas | Guía 2025.

Error #3 – No Verificar la Información Generada

Este error puede ser todavía más insidioso porque te hace parecer incompetente sin que tengas mala intención.

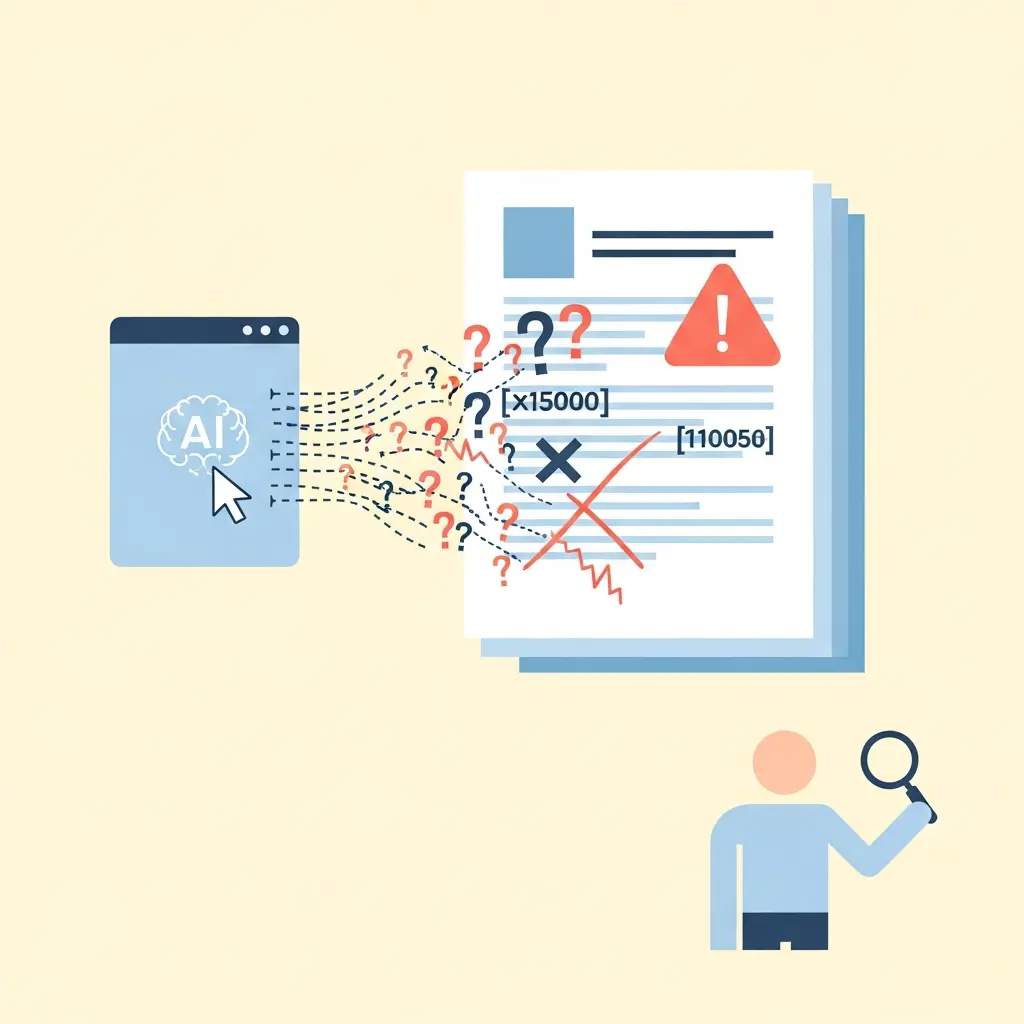

En el ámbito de la IA, una «alucinación» es cuando el modelo genera información que parece real pero es completamente inventada. No es un bug, es una característica inherente a cómo funcionan estos sistemas.

Ejemplos reales de alucinaciones que han arruinado trabajos incluyen citas de papers que no existen, estadísticas completamente fabricadas, referencias a autores que nunca escribieron lo que se les atribuye, y normativa derogada o inexistente.

Lo terrorífico es que incluso GPT-4 y los modelos más avanzados alucinan. La sofisticación no elimina el problema, solo lo hace más convincente.

Imagina que citas un estudio de 2022 sobre tu tema de investigación. Incluyes el nombre del autor, la revista, el título. Todo perfecto. Excepto que ese estudio no existe. Cuando un miembro del tribunal intenta verificar esa fuente y descubre que la «inventaste», tienes un problema serio. No importa que la IA lo generara. Tú lo firmaste.

🔍 Regla de oro:

Ningún dato generado por IA va a tu tesis sin verificación con fuentes primarias.

Tu checklist de verificación debe incluir: confirmar que la fuente existe en bases de datos académicas, verificar que no sea información obsoleta, contrastar cifras y fechas con el documento original, y leer la fuente completa en lugar de confiar en el resumen de la IA.

Según los Principios de IA de la OCDE, los humanos somos responsables de las decisiones que tomamos basándonos en sistemas de IA. Para evitar errores específicos de citación, consulta nuestra guía 5 Errores al Citar IA en Tesis | Guía Citación 2025.

Error #4 – Usar IA para Evadir el Proceso de Aprendizaje

Este es el error más difícil de detectar externamente, pero el que más daño te hace a ti mismo.

No estoy hablando de copiar descaradamente. Estoy hablando de algo mucho más sutil: pedir a la IA que «piense por ti» en lugar de asistirte, usar parafraseo automático para evitar comprender las fuentes, generar secciones completas sin proceso reflexivo, o delegar la estructura argumentativa porque «la IA lo hace mejor».

¿Te suena familiar? No es porque seas mala persona. Es porque estás agotado, tienes presión de tiempo, y la IA ofrece un atajo aparente.

Pero la tesis no es un producto que entregas a cambio de un título. Es un proceso de aprendizaje que te transforma en un profesional competente. Cuando evades ese proceso, te fraudas a ti mismo, perjudicas a la institución, y te expones en la defensa, el momento de la verdad donde no puedes consultar nada.

Antes de entregar tu tesis, hazte estas preguntas con honestidad brutal: ¿Puedo explicar cada decisión sin consultar nada? ¿Entiendo por qué descarté alternativas? Si la respuesta a cualquiera de ellas es «no», tienes trabajo pendiente.

Protege Tu Trabajo: Los Siguientes Pasos

Estos cuatro errores comparten un denominador común: son completamente evitables con información correcta y una actitud proactiva. No necesitas dejar de usar IA; necesitas usarla de forma ética, transparente y responsable.

La diferencia entre el estudiante que aprueba con la conciencia tranquila y el que enfrenta sanciones no está en el talento ni en las herramientas que usa. Está en cómo las usa y cómo lo comunica.

Tu tesis merece llegar a buen puerto. Y mereces defenderla con la tranquilidad de saber que has hecho las cosas bien.

Deja una respuesta