Análisis Factorial Exploratorio (AFE) con SPSS: Guía Completa con Ejemplo para TFG 2026

El análisis factorial exploratorio (AFE) con SPSS es una de las técnicas estadísticas más demandadas en los trabajos de fin de grado y tesis doctorales de ciencias sociales, psicología, educación y ciencias de la salud. Cuando construyes o adaptas un cuestionario, necesitas demostrar que los ítems miden realmente los factores latentes que supones. El AFE es la herramienta que permite descubrir esa estructura sin imponerla a priori. Sin embargo, su correcta aplicación exige conocer los supuestos, elegir los métodos adecuados de extracción y rotación, e interpretar los resultados con rigor metodológico.

Esta guía recorre todo el proceso: desde la preparación de la matriz de correlaciones hasta la redacción de resultados en formato APA 7, pasando por cada decisión que debes justificar ante tu tribunal. Si usas SPSS y necesitas validar un instrumento en tu TFG o tesis, este artículo es tu referencia de cabecera.

¿Qué es el análisis factorial exploratorio y cuándo usarlo?

El análisis factorial exploratorio es una técnica multivariante cuyo objetivo es identificar un número reducido de variables latentes (factores) que expliquen las correlaciones observadas entre un conjunto mayor de ítems o variables manifiestas. A diferencia del análisis factorial confirmatorio (AFC), el AFE no parte de un modelo predefinido: deja que los datos determinen cuántos factores existen y qué ítems saturan en cada uno.

Se aplica principalmente en tres situaciones:

- Construcción de escalas nuevas: cuando elaboras un cuestionario original y necesitas explorar su dimensionalidad.

- Adaptación de instrumentos: cuando traduces o adaptas una escala a una nueva población y quieres verificar que la estructura factorial se mantiene.

- Fase exploratoria previa al AFC: cuando no existe suficiente respaldo teórico para especificar un modelo confirmatorio.

El AFE no es adecuado cuando ya tienes una teoría sólida sobre la estructura del instrumento; en ese caso, el AFC es la opción correcta.

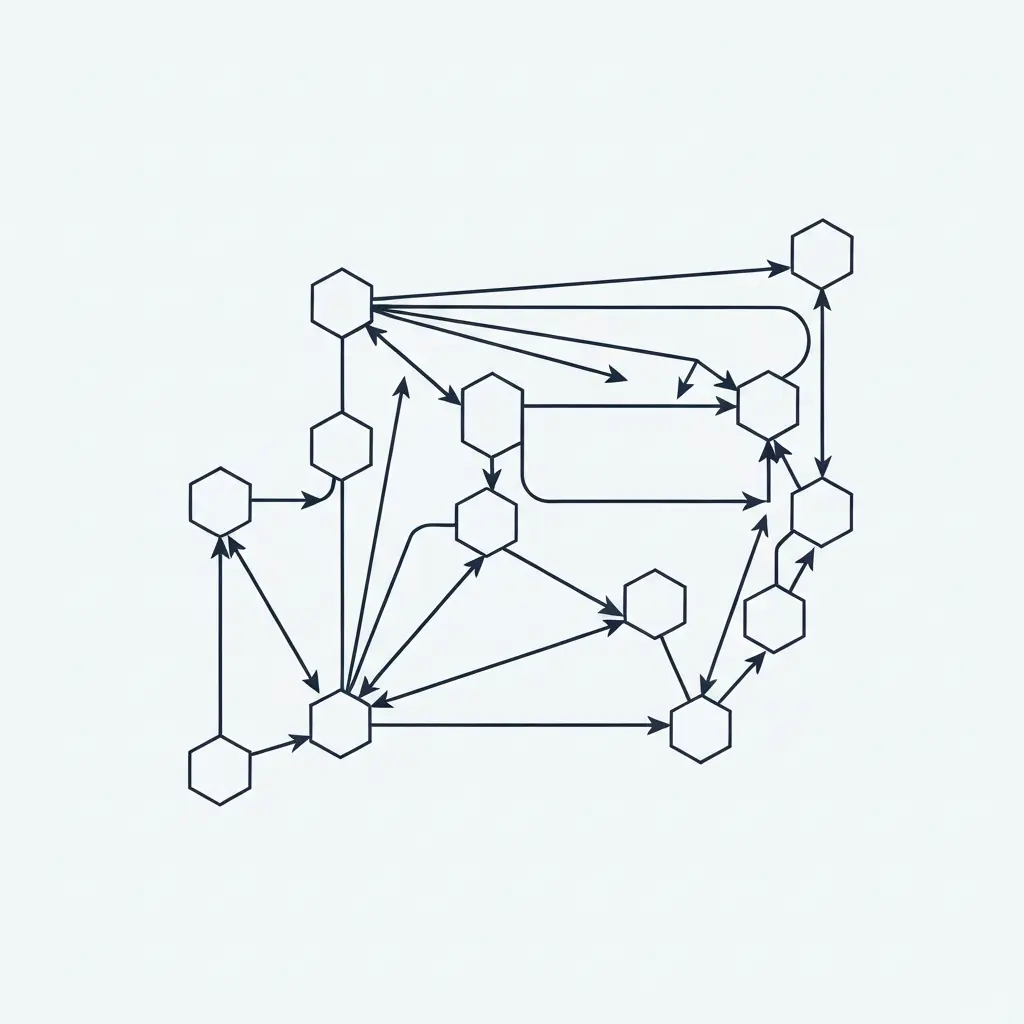

Fuente: Poncho Enseña — Análisis Factorial Exploratorio: guía práctica

Supuestos previos: tamaño muestral, KMO y Bartlett

Tamaño muestral

El tamaño de la muestra condiciona directamente la estabilidad de los resultados. Las recomendaciones actuales, basadas en estudios de simulación, vinculan el mínimo necesario con la comunalidad media de los ítems y el número de indicadores por factor:

| Comunalidad media | Indicadores por factor | N mínimo recomendado |

|---|---|---|

| Alta (> 0.70) | 6 o más | 150–200 |

| Moderada (0.40–0.70) | 3–4 | 200–300 |

| Baja (≈ 0.30) | 3 | 400–500 |

Para matrices policóricas (datos ordinales de escala Likert), se recomienda N ≥ 300 por la mayor inestabilidad del estimador.

Índice KMO

El índice Kaiser-Meyer-Olkin evalúa si las correlaciones parciales entre variables son suficientemente pequeñas como para que los factores comunes expliquen la varianza compartida. Los umbrales estándar son:

- > 0.90: excelente

- 0.80–0.89: satisfactorio (mínimo recomendado para publicación)

- 0.70–0.79: suficiente

- 0.60–0.69: mediocre

- < 0.50: inadecuado, no proceder con el AFE

Prueba de esfericidad de Bartlett

Contrasta la hipótesis nula de que la matriz de correlaciones es una matriz identidad (todas las correlaciones son cero). Para que el AFE tenga sentido, se requiere p < 0.05. Con muestras grandes (N > 500), esta prueba resulta significativa casi siempre, por lo que el KMO cobra mayor relevancia diagnóstica.

Métodos de extracción: PCA vs ULS vs ML

Uno de los errores más extendidos en los TFG es utilizar el Análisis de Componentes Principales (PCA) como método de extracción en el AFE. El PCA y el análisis factorial son técnicas distintas con objetivos diferentes: el PCA reduce dimensiones explicando la varianza total, mientras que el análisis factorial modela solo la varianza común (comunalidades). Mezclarlos es un error metodológico grave que los revisores detectan inmediatamente.

| Método | Varianza que modela | Cuándo usar |

|---|---|---|

| PCA | Total (común + única) | Reducción de dimensiones, no AFE |

| ULS / Mínimos cuadrados | Común | Datos ordinales, distribuciones no normales |

| ML / Máxima verosimilitud | Común | Datos continuos con distribución normal |

En la práctica de los TFG, donde los instrumentos suelen ser escalas Likert de 5 o 7 puntos, el método ULS con matriz policórica es el más apropiado. SPSS no genera matrices policóricas de forma nativa, por lo que muchos investigadores usan el programa FACTOR (Lorenzo-Seva & Ferrando, disponible gratuitamente) o R/jamovi como alternativa cuando los ítems son claramente ordinales.

¿Cuántos factores retener? Criterios y decisión

La decisión sobre cuántos factores conservar es la más crítica del AFE y la que más controversia genera. No existe un único criterio infalible; la recomendación metodológica actual es usar varios criterios de forma convergente:

Criterio de Kaiser (valores propios > 1)

Retener los factores con valor propio (eigenvalue) superior a 1. Es el criterio predeterminado en SPSS. Su principal limitación es que tiende a sobreextracción, especialmente con muchos ítems. Se considera el criterio menos preciso cuando se usa en solitario.

Gráfico de sedimentación (Scree Plot)

Traza los valores propios ordenados de mayor a menor. El punto de inflexión (codo) indica cuántos factores retener. Es más visual que matemático, pero eficaz cuando el codo es claro. En SPSS: Análisis factorial → Extracción → marcar «Gráfico de sedimentación».

Análisis paralelo (Horn, 1965)

Compara los valores propios obtenidos con los de muestras aleatorias del mismo tamaño. Se retienen solo los factores cuyos valores propios superan los generados aleatoriamente. Es el criterio más preciso disponible. SPSS no lo implementa directamente, pero puede ejecutarse en FACTOR, R (paquete psych) o jamovi.

Varianza explicada acumulada

Como regla práctica complementaria, el conjunto de factores retenidos debería explicar al menos el 50–60% de la varianza. En ciencias sociales, con datos con ruido, el 50% se considera aceptable; en psicometría clínica, se aspira al 60% o más.

Rotación ortogonal vs oblicua: por qué siempre preferir oblicua

Una vez extraídos los factores, la rotación facilita la interpretación al maximizar las cargas altas y minimizar las bajas. La elección entre rotación ortogonal y oblicua es teórica, no estadística:

- Rotación ortogonal (Varimax, Quartimax): asume que los factores son independientes entre sí (correlación = 0). Esta suposición rara vez es realista en ciencias sociales, donde los constructos psicológicos suelen estar relacionados.

- Rotación oblicua (Direct Oblimin, Promax): permite que los factores correlacionen entre sí. Produce resultados más ajustados a la realidad teórica y, paradójicamente, más interpretables cuando los factores son realmente independientes (las correlaciones entre factores serán simplemente cercanas a cero).

La recomendación metodológica consolidada es usar siempre rotación oblicua como primera opción. Si la correlación entre factores resultante es inferior a 0.20–0.30, se puede concluir que la independencia es razonable, pero no es necesario cambiar a rotación ortogonal.

En SPSS: Análisis factorial → Rotación → Direct Oblimin (delta = 0) o Promax (kappa = 4). La rotación oblicua genera dos matrices: la matriz de patrón (cargas de regresión, la que se interpreta) y la matriz de estructura (correlaciones factor-ítem).

Interpretación de la matriz de cargas factoriales

Con rotación oblicua, la interpretación se basa en la matriz de patrón. Los criterios de corte para considerar que un ítem satura significativamente en un factor son:

- Carga ≥ 0.40: mínimo aceptable para muestras menores de 300.

- Carga ≥ 0.30: aceptable para muestras grandes (> 300).

- Doble saturación problemática: si un ítem carga 0.50 en el Factor 1 y 0.45 en el Factor 2, la diferencia es insuficiente. Se recomienda eliminar el ítem si la diferencia entre la carga principal y la secundaria es menor de 0.20.

Los ítems que no alcanzan el umbral mínimo en ningún factor, o que presentan doble saturación, deben eliminarse y repetir el análisis. Esta depuración iterativa es parte del proceso y debe describirse en la sección de resultados.

Ejemplo completo paso a paso en SPSS

Para ilustrar el proceso, utilizamos un ejemplo ficticio pero metodológicamente realista: la validación de la Escala de Autorregulación del Aprendizaje (EAA) compuesta por 20 ítems de escala Likert de 5 puntos, administrada a 285 estudiantes universitarios.

Paso 1: Verificar supuestos

En SPSS: Analizar → Reducción de dimensiones → Análisis factorial. Introducir todos los ítems en el bloque «Variables». En «Descriptivos», activar KMO y prueba de Bartlett.

Resultado obtenido: KMO = 0.87; Bartlett: χ²(190) = 1847.3, p < 0.001. Ambos criterios son satisfactorios.

Paso 2: Seleccionar el método de extracción

En «Extracción», seleccionar Mínimos cuadrados no ponderados (ULS). Marcar «Gráfico de sedimentación». Establecer el criterio en «Basándose en valores propios mayores que 1» como primera exploración.

Resultado: El Kaiser sugiere 4 factores; el scree plot muestra un codo claro tras el 3.er factor; el análisis paralelo (realizado en FACTOR) confirma 3 factores. Decisión: retener 3 factores.

Paso 3: Solicitar rotación oblicua

En «Rotación», seleccionar Direct Oblimin con delta = 0. Activar la visualización de la matriz de patrón.

Correlaciones entre factores: r(F1,F2) = 0.34; r(F1,F3) = 0.28; r(F2,F3) = 0.19. La correlación moderada confirma que la rotación oblicua era adecuada.

Paso 4: Interpretar la matriz de patrón

| Ítem | Factor 1 | Factor 2 | Factor 3 |

|---|---|---|---|

| EAA_01 | 0.72 | 0.08 | 0.11 |

| EAA_07 | 0.12 | 0.68 | 0.09 |

| EAA_14 | 0.09 | 0.14 | 0.71 |

| EAA_09 (eliminado) | 0.43 | 0.38 | 0.12 |

El ítem EAA_09 se elimina por doble saturación (diferencia < 0.20). Tras eliminar 2 ítems problemáticos, se repite el análisis con 18 ítems.

Paso 5: Calcular la fiabilidad de cada factor

Tras la solución final de 3 factores con 18 ítems, se calcula el coeficiente omega de McDonald (ω) para cada subescala: F1: ω = 0.87; F2: ω = 0.83; F3: ω = 0.80. Todos superan el umbral de 0.70.

Cómo redactar los resultados del AFE en APA 7

La redacción de los resultados del AFE debe ser concisa pero completa. A continuación se muestra un fragmento modelo:

«Se realizó un análisis factorial exploratorio (AFE) mediante el método de extracción por mínimos cuadrados no ponderados (ULS) y rotación oblicua Direct Oblimin, dado el carácter ordinal de los ítems y la expectativa de correlaciones entre factores. Previamente se verificaron los supuestos de adecuación muestral: KMO = 0.87 y prueba de esfericidad de Bartlett significativa [χ²(190) = 1847.3, p < 0.001]. El análisis paralelo (n = 1000 réplicas) indicó retener 3 factores, que explican el 58.4% de la varianza común. Dos ítems con doble saturación (diferencia < 0.20) fueron eliminados. La solución final de 18 ítems muestra cargas factoriales entre .51 y .79, con comunalidades entre .42 y .73. La fiabilidad de cada subescala, estimada mediante el coeficiente omega, resultó satisfactoria (ω entre .80 y .87).»

Errores frecuentes en el AFE y cómo evitarlos

- Usar PCA como método de extracción: PCA no es análisis factorial. Usa ULS o ML.

- Fiarse solo del criterio de Kaiser: sobreestima el número de factores. Combínalo con el scree plot y el análisis paralelo.

- Usar rotación Varimax por defecto: es ortogonal y asume independencia entre factores, lo que suele ser teóricamente indefendible en ciencias sociales.

- Interpretar la matriz de estructura en lugar de la de patrón: con rotación oblicua, la matriz a reportar e interpretar es la matriz de patrón.

- No reportar las correlaciones entre factores: son informativas y forman parte de la solución oblicua.

- Usar Cronbach α sin verificar unidimensionalidad: antes del alfa, verifica con el AFE que la subescala es unidimensional; en caso contrario, usa el omega total (ωt).

- No describir el proceso de depuración iterativa: si eliminaste ítems, debes explicar en qué paso y por qué criterio.

AFE vs AFC: ¿cuándo pasar al análisis confirmatorio?

El AFE genera hipótesis sobre la estructura factorial; el AFC las pone a prueba. El flujo recomendado en metodología de investigación es:

- Realizar el AFE con una muestra (muestra de calibración).

- Con una segunda muestra independiente (muestra de validación), ajustar un modelo AFC basado en la estructura obtenida.

- Evaluar el ajuste del AFC con índices como CFI > 0.95, RMSEA < 0.06, SRMR < 0.08.

Si no dispones de dos muestras independientes, otra opción es utilizar modelos de ecuaciones estructurales con AMOS, que permiten comparar modelos alternativos. En cualquier caso, no es metodológicamente correcto usar la misma muestra para el AFE y el AFC sin reconocer la limitación.

Para profundizar en la fiabilidad de las subescalas derivadas del AFE, consulta nuestra guía sobre el coeficiente omega de McDonald vs alfa de Cronbach. Si tu diseño implica variables mediadoras, el siguiente paso natural es el análisis de mediación con la macro PROCESS.

Preguntas frecuentes sobre el AFE en SPSS

¿Cuál es la diferencia entre AFE y PCA en SPSS?

¿Qué valor mínimo de KMO se necesita para hacer el AFE?

¿Por qué se recomienda la rotación oblicua en lugar de Varimax?

¿Cuántos ítems por factor son suficientes para el AFE?

¿Cómo se reporta el AFE en formato APA 7?

¿SPSS realiza el análisis paralelo automáticamente?

Valida tu instrumento con Tesify

Si estás desarrollando o adaptando un cuestionario para tu TFG o tesis y necesitas orientación en el proceso de validación factorial, Tesify te asiste en la interpretación de los resultados del SPSS, la redacción de la sección de resultados en APA 7 y la conexión entre el AFE y el AFC confirmatorio. Desde la verificación de supuestos hasta el reporte final, con el rigor metodológico que exige el tribunal.

Deja una respuesta