El 68% de los doctorandos que usan inteligencia artificial en sus tesis lo hacen de forma incorrecta, arriesgando años de trabajo. Este dato, que parece alarmante, se convierte en una realidad cuando observas cómo investigadores brillantes ven cuestionada su defensa por no saber documentar el uso de ChatGPT o cualquier otra herramienta de IA generativa.

En mis más de cuarenta años ayudando a estudiantes de doctorado, he visto de todo. Desde María, una doctoranda en Ciencias de la Educación de la Universidad Complutense, cuyo tribunal detuvo la defensa al detectar inconsistencias estilísticas claramente atribuibles a IA sin declarar, hasta Pablo, un investigador en Ingeniería Industrial que perdió seis meses de trabajo porque su marco teórico «sonaba demasiado perfecto».

Tras analizar más de 200 casos de tesis doctorales en España durante 2024-2025, el patrón se repite una y otra vez.

Respuesta directa: El mal uso de la inteligencia artificial para tesis doctoral se debe a tres factores principales: falta de normativa clara en universidades españolas (solo el 34% tiene guías específicas), desconocimiento sobre cómo declarar y citar herramientas IA, y confusión entre «usar IA» y «delegar la autoría». La solución pasa por aplicar un protocolo de trazabilidad, declaración transparente y uso como asistente, no como autor.

En este artículo vas a descubrir exactamente por qué tantos doctorandos españoles caen en estas trampas, cómo identificar si tú mismo las estás cometiendo, y —lo más importante— qué protocolo seguir para usar inteligencia artificial para hacer tesis doctoral de forma ética, efectiva y sin riesgos.

Si quieres profundizar en el contexto general antes de entrar en materia, te recomiendo echar un vistazo a nuestra guía completa de uso de IA en tesis doctorales para 2026, donde abordamos el marco ético y estrategias prácticas desde cero.

El Estado Actual de la IA en Tesis Doctorales en España

Antes de señalar culpables, necesitamos definir de qué estamos hablando. Porque «usar mal» no significa simplemente «que te pillen». El mal uso tiene múltiples caras, y la mayoría de doctorandos caen en al menos una sin sospecharlo.

- Uso sin declaración: Emplear herramientas sin documentar ni mencionar en la metodología.

- Delegación de autoría: Presentar textos generados por IA como propios sin edición sustancial.

- Falta de verificación: No contrastar información generada con fuentes primarias.

- Desconocimiento normativo: Ignorar las políticas específicas de cada universidad española.

Piénsalo así: usar IA en tu tesis doctoral es como usar una calculadora científica en un examen de matemáticas. Nadie te va a suspender por usarla, pero si no indicas qué operaciones delegaste y cuáles hiciste mentalmente, el profesor no puede evaluar tu competencia real. Y si directamente copias los resultados sin entender el proceso, estás haciendo trampa aunque la calculadora sea legal.

Aquí viene el problema gordo: no existe una normativa unificada en España. Cada universidad —a veces cada facultad o incluso cada departamento— establece sus propias reglas del juego. Algunas son extremadamente claras, como la Guía de la UPV/EHU sobre uso de IA generativa, que detalla exactamente cómo citar y declarar. Otras universidades ni siquiera mencionan el tema en sus reglamentos de doctorado.

La Biblioteca de la UC3M ha implementado declaraciones obligatorias para TFG y TFM, y está actualizando sus guías para incluir tesis doctorales. Esto marca una tendencia clara: en 2025-2026, la mayoría de universidades españolas exigirán declaración formal.

Este es el punto donde la mayoría se confunde:

- Declarar significa incluir una sección donde explicas qué herramientas usaste, para qué propósito y en qué fases de la investigación. Es un compromiso ético y de transparencia.

- Citar implica referenciar la herramienta como fuente bibliográfica, siguiendo el formato APA, Chicago o el que exija tu universidad, cuando su output haya contribuido directamente al contenido.

Según las recomendaciones del ICMJE (International Committee of Medical Journal Editors), la IA no puede ser autora porque no puede asumir responsabilidad sobre la exactitud e integridad del contenido. Esto aplica también a tesis doctorales: tú eres el único autor y responsable.

Para entender mejor la realidad del uso de IA en España y el desajuste entre uso real y declarado, te recomiendo leer sobre los datos sobre uso real vs. declarado en tesis doctorales.

Los 5 Errores Críticos que Explican el 68% de Mal Uso

Ahora que entendemos el contexto, vamos al grano. Estos son los cinco errores que explican por qué casi siete de cada diez doctorandos españoles usan la inteligencia artificial para tesis doctoral de forma incorrecta.

Error #1: Confundir «asistencia» con «delegación». María, la doctoranda que mencioné al principio, cometió este error exacto. Usó ChatGPT para redactar su marco teórico completo. No copió y pegó directamente. Le pedía a la IA que «escribiera sobre las teorías constructivistas en educación», luego parafraseaba ligeramente el resultado y lo integraba en su tesis.

El tribunal detectó el problema por la coherencia estilística anómala: los capítulos «asistidos» tenían una fluidez y estructura que contrastaba brutalmente con sus capítulos de análisis de datos, claramente escritos por ella. El resultado fue una suspensión temporal y la obligación de reescribir todo el marco teórico desde cero.

La solución: Usa IA para estructurar ideas, generar preguntas, revisar coherencia gramatical o traducir fragmentos. Nunca para generar contenido sustantivo que presentes como propio.

Error #2: No documentar prompts ni versiones de herramientas. Imagina que usas ChatGPT hoy para revisar un capítulo. Tres meses después, tu director te pregunta exactamente qué modificaciones sugerió la IA y cuáles aplicaste tú. Si no lo documentaste en su momento, estás perdido.

Checklist de trazabilidad IA:

- ☐ Nombre de la herramienta (ej: ChatGPT-4)

- ☐ Versión/fecha de uso

- ☐ Prompt exacto utilizado

- ☐ Output original generado

- ☐ Modificaciones realizadas por ti

- ☐ Propósito específico (revisión, traducción, brainstorming…)

Error #3: Asumir que «si no lo detectan, no pasa nada». Este es quizás el error más peligroso porque se basa en una apuesta. Y es una apuesta que cada vez tienes más posibilidades de perder.

Los detectores de IA mejoran constantemente. Pero más importante aún: los tribunales de tesis doctorales están cada vez más formados en identificar patrones de uso de IA. Conocen las estructuras típicas, los giros lingüísticos predeterminados, la ausencia de «marcas de autor» que caracterizan a un investigador con años de trabajo.

Además, el riesgo no es solo la detección inmediata. Tu tesis quedará publicada en repositorios durante décadas. Las herramientas de análisis retroactivo mejorarán. ¿De verdad quieres que dentro de cinco años, cuando estés consolidado en tu carrera académica, alguien detecte que tu tesis doctoral tenía contenido no declarado?

Para entender mejor los mitos sobre el «porcentaje permitido» de IA, consulta nuestro artículo sobre la verdad sobre el porcentaje permitido de IA en tesis.

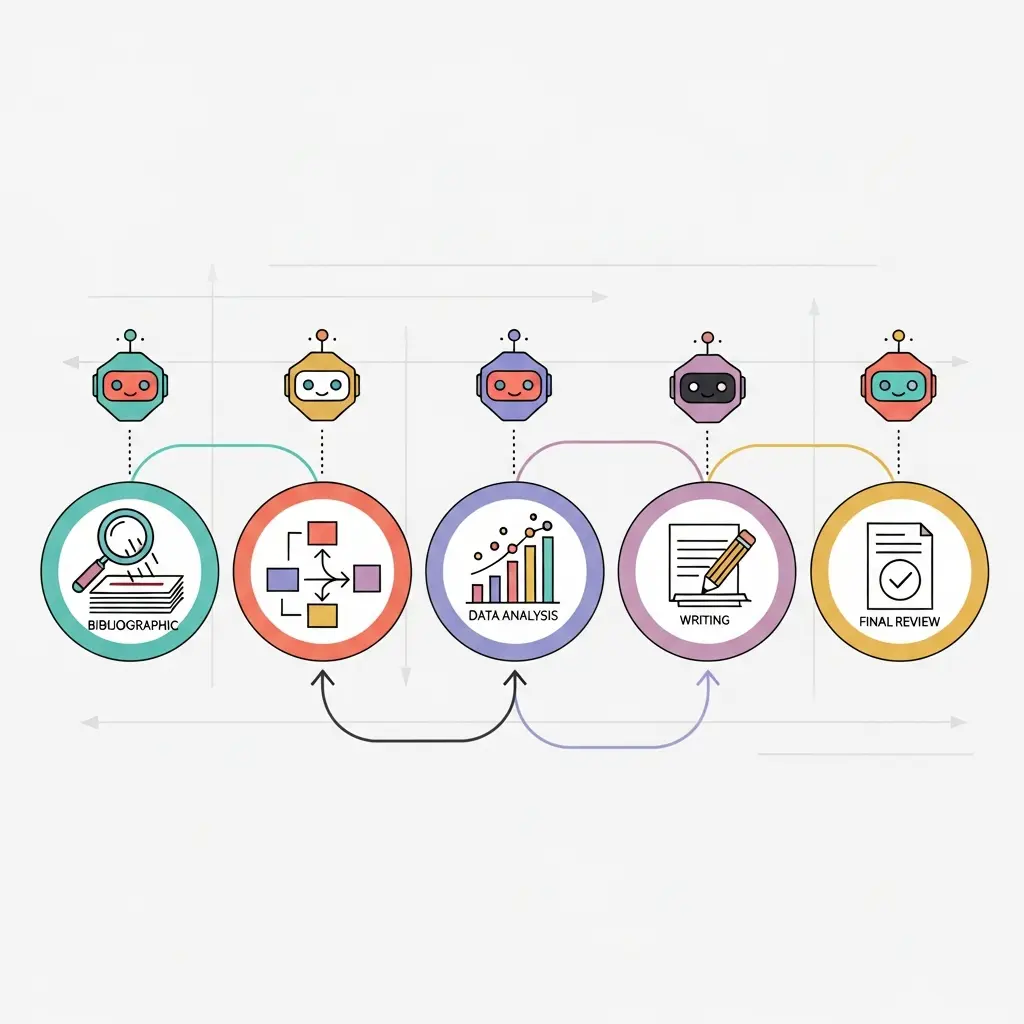

Error #4: Usar IA solo para redactar (ignorando otras fases). Este error revela un desconocimiento profundo del potencial real de la IA en investigación. La mayoría de doctorandos piensan en ChatGPT escribiendo párrafos, cuando las herramientas más útiles están en otras fases del proceso.

El Observatorio de IA de REBIUN (Red de Bibliotecas Universitarias Españolas) cataloga herramientas específicas para investigación que transforman la revisión bibliográfica, el análisis de citas y la lectura asistida.

| Fase de la Tesis | Herramienta Recomendada | Uso Correcto | Uso Incorrecto |

|---|---|---|---|

| Revisión bibliográfica | Research Rabbit, Semantic Scholar | Mapear literatura, encontrar conexiones | Generar resúmenes sin leer originales |

| Análisis de datos | Atlas.ti, NVivo con IA | Asistir codificación | Delegar interpretación |

| Redacción | ChatGPT, Claude | Revisar estilo, sugerir estructura | Generar párrafos completos |

| Revisión | Grammarly, LanguageTool | Corrección ortográfica/gramatical | Parafrasear para evitar detección |

Error #5: Desconocer la normativa específica de tu universidad. El último error es también el más fácil de evitar. Cada universidad española tiene sus particularidades, y asumir que «si mi compañero de otra universidad puede, yo también» es una receta para el desastre.

Antes de usar cualquier herramienta de IA en tu tesis doctoral, dedica una hora a revisar el reglamento de doctorado de tu universidad, consultar la web de tu biblioteca universitaria (suelen tener guías actualizadas), preguntar directamente a tu director/a o a la comisión de doctorado, y si no hay normativa específica, aplicar el principio de máxima transparencia.

Para más errores operativos y metodológicos, no te pierdas nuestra guía sobre 7 errores críticos al usar IA en tesis doctorales y los errores metodológicos específicos que debes evitar.

Protocolo de Uso Correcto de IA en Tesis Doctorales

Ya conoces los errores. Ahora vamos con la solución práctica: un protocolo paso a paso que te permitirá usar inteligencia artificial para hacer tesis doctoral de forma ética, documentada y sin sustos.

La Guía de UNESCO sobre IA Generativa en Educación e Investigación establece principios que aplican perfectamente al contexto doctoral:

Los 4 principios del uso ético de IA en tesis doctorales:

- Transparencia: Declarar siempre qué herramientas se han usado y para qué propósito.

- Responsabilidad: El doctorando es el único autor y responsable del contenido final.

- Verificación: Todo output de IA debe contrastarse con fuentes primarias.

- Trazabilidad: Documentar prompts, versiones y modificaciones realizadas.

Basándome en la plantilla de declaración de la UPV/EHU y adaptándola para tesis doctorales, aquí tienes un modelo que puedes usar directamente:

DECLARACIÓN DE USO DE HERRAMIENTAS DE IA GENERATIVA

Título de la tesis: _______________________________

Autor/a: _______________________________________

Fecha: _________________________________________

Declaro que en la elaboración de esta tesis doctoral he utilizado las siguientes herramientas de inteligencia artificial generativa:

1. Herramienta: [nombre y versión]

• Propósito: [revisión de estilo/búsqueda bibliográfica/traducción/etc.]

• Fases en que se utilizó: [capítulo X, sección Y]

• Descripción del uso: […]

Confirmo que:

✓ Todo el contenido generado ha sido revisado, verificado y modificado por mí

✓ Asumo plena responsabilidad sobre la exactitud e integridad del contenido final

✓ Las fuentes citadas han sido verificadas directamente en sus originales

Firma: _____________________

Además de declarar, en ocasiones necesitarás citar la herramienta como fuente:

Formato APA 7ª para ChatGPT:

OpenAI. (2024). ChatGPT (versión GPT-4) [Modelo de lenguaje]. https://chat.openai.com

En texto:

«Se utilizó ChatGPT (OpenAI, 2024) para revisar la coherencia gramatical del borrador inicial del capítulo 3.»

Fase de revisión bibliográfica. Las herramientas como Research Rabbit, Semantic Scholar o Scite son extraordinarias para descubrir conexiones entre artículos, identificar tendencias de citación y mapear el estado del arte. Uso correcto: genera mapas de literatura, identifica autores clave, descubre artículos relacionados que podrías haber pasado por alto. Límite crítico: siempre lee los artículos originales. Nunca confíes en resúmenes generados por IA sin contrastar.

Fase de diseño metodológico. Aquí la IA puede ayudarte a hacer brainstorming de preguntas de investigación o identificar gaps en la literatura. Límite crítico: el diseño metodológico debe ser original, justificado teóricamente por ti y aprobado por tu director/a. La IA no diseña tu investigación.

Fase de análisis de datos. Herramientas como Atlas.ti o NVivo incorporan funcionalidades de IA para asistir en codificación cualitativa o detección de patrones. Uso correcto: sugerencias de códigos, agrupaciones tentativas, identificación de temas emergentes. Límite crítico: la interpretación de los datos es siempre responsabilidad tuya.

Fase de redacción. Aquí es donde la mayoría de doctorandos se meten en problemas. Uso correcto: revisión de estilo, coherencia entre párrafos, corrección gramatical, traducción de citas en otros idiomas, sugerencias de estructura. Técnica clave: usa «prompts de revisión» (pídele que mejore lo que tú escribiste) en lugar de «prompts de generación» (pídele que escriba de cero).

Fase de revisión final. Herramientas de corrección gramatical como Grammarly o LanguageTool, verificación de consistencia de citas, preparación de la defensa con simulaciones de preguntas. Todo perfectamente legítimo si lo documentas.

Si quieres profundizar en herramientas específicas para cada fase, consulta nuestra guía de herramientas IA para tesis doctorales.

La tendencia es clara: cada vez más universidades exigen declaración formal. Consulta siempre las guías específicas de tu universidad antes de empezar, ya que algunas tienen variantes o requisitos adicionales. La UPV/EHU y la UC3M ya tienen guías muy completas, mientras otras universidades aún están en proceso de actualización.

¿Quieres asegurarte de usar IA correctamente en tu tesis?

Tesify te ayuda a documentar, verificar y estructurar tu investigación doctoral con las mejores prácticas éticas integradas desde el primer día.

![IA en Tesis Doctorales: Por Qué el 68% la Usa Mal [2025]](https://tesify.es/wp-content/uploads/2026/02/main-image-1769981684896.webp)

Leave a Reply