Te han dicho que existe un porcentaje de IA permitido en tu tesis. Te mintieron.

Después de más de cuatro décadas escribiendo sobre educación y tecnología, jamás había presenciado tanta confusión como la que existe ahora mismo entre estudiantes universitarios españoles. Cada semana llegan mensajes desesperados a mi bandeja de entrada: “¿Puedo usar el 20% de IA?”, “Mi compañero usó ChatGPT y le fue bien, ¿por qué a mí me pillarían?”, “El detector me da 15%, ¿estoy a salvo?”

La realidad es demoledora: no existe ningún porcentaje mágico. Las universidades no te lo dicen claramente porque ni ellas mismas tienen las respuestas. Los detectores fallan más de lo que funcionan. Y los profesores evalúan con criterios completamente diferentes entre sí.

En este artículo voy a revelarte lo que realmente necesitas saber sobre los límites del uso de inteligencia artificial en contenido de tesis académicas. Nada de advertencias genéricas ni consejos vacíos que ya has leído mil veces. Aquí descubrirás lo que universidades, detectores y normativas no te explican.

Lo que realmente define los límites en 2025:

Los límites del uso de inteligencia artificial en contenido de tesis académicas no se definen por un porcentaje específico, sino por tres criterios: la política particular de cada institución, el tipo de uso (asistido vs. delegado), y la capacidad del estudiante para demostrar autoría intelectual del trabajo.

Si quieres entender el contexto normativo completo antes de continuar, te recomiendo consultar nuestra Guía Completa 2025 sobre Límites de IA en Tesis Académicas. Pero quédate aquí primero, porque lo que vas a leer cambiará completamente tu perspectiva.

El Contexto Que Nadie Explica

Imagina esto: llevas 30 años siendo profesor universitario, evaluando trabajos con los mismos criterios de siempre. De repente, en noviembre de 2022, aparece ChatGPT y en cuestión de semanas tus estudiantes pueden generar textos que parecen escritos por académicos experimentados.

El sistema educativo entró en shock.

La primera reacción fue predecible: prohibiciones totales, pánico generalizado, amenazas de expulsión. Algunas universidades españolas llegaron a prohibir cualquier mención de herramientas de IA en los trabajos académicos. Fue como intentar prohibir internet en 1998.

Pero algo interesante ocurrió entre 2023 y 2024: las instituciones más progresistas empezaron a darse cuenta de que prohibir la IA era tan absurdo como prohibir las calculadoras en los años 70. El problema no era la herramienta, sino cómo se usaba.

Hoy en día, toda la normativa sobre límites del uso de inteligencia artificial en contenido de tesis académicas se sustenta en tres principios fundamentales:

- Integridad académica: Tu trabajo debe reflejar tu aprendizaje, no el de una máquina.

- Responsabilidad autoral: No puedes atribuirte lo que no creaste. Si la IA genera un argumento brillante, ese argumento no es tuyo aunque lo firmes.

- Evaluación justa: Los profesores necesitan evaluar tu competencia, no la capacidad de ChatGPT de producir texto coherente.

📄 Marco de Referencia Internacional: La UNESCO estableció en 2023 directrices fundamentales sobre IA generativa en educación que justifican por qué las universidades imponen restricciones. Puedes consultar el documento completo: UNESCO Guidance for Generative AI in Education and Research (PDF).

🎓 Criterio de Integridad Académica (ENAI): La European Network for Academic Integrity distingue entre uso autorizado y declarado vs. no autorizado/no declarado. El segundo caso se considera mala conducta académica, independientemente del porcentaje. Lee las Recomendaciones ENAI sobre uso ético de IA en educación.

Del “Prohibido” al “Demuestra Que Es Tuyo”

Aquí viene una de las verdades más importantes de este artículo: las reglas del juego han cambiado radicalmente, pero nadie te lo ha comunicado formalmente.

En 2023, la lógica era simple y brutal: “¿Usaste IA?” significaba fraude automático. “¿El detector marca positivo?” implicaba expediente disciplinario.

En 2025, la lógica es completamente diferente: “¿Puedes demostrar tu proceso?” determina la evaluación del aprendizaje. “¿Entiendes y puedes defender cada palabra?” valida tu autoría.

Las universidades más avanzadas ya no se preguntan “¿usó IA?” sino “¿cómo la usó y puede demostrarlo?”. Esto se traduce en requisitos concretos:

- Bitácoras de proceso creativo: Registro de cómo evolucionó tu trabajo desde el primer borrador.

- Historial de versiones documentado: Pruebas de que escribiste, revisaste y refinaste tu contenido.

- Declaraciones de uso de IA específicas: Qué herramienta, qué versión, para qué propósito exacto.

📋 Estándar de Publicaciones Científicas: Las Recomendaciones WAME sobre ChatGPT establecen que la IA nunca puede ser autora, el uso debe declararse con detalles técnicos, y la responsabilidad final es siempre humana.

Profundiza en los 7 Secretos sobre IA en Redacción de Tesis que nadie te cuenta.

| Postura Institucional | Características |

|---|---|

| Restrictiva | Prohibición casi total de cualquier herramienta de IA |

| Permisiva regulada | Uso permitido con declaración obligatoria (mayoría en 2025) |

| Integradora | IA como herramienta evaluada y parte del proceso |

Los 5 Insights Que Cambian Todo

Insight #1: No existe un “porcentaje de IA permitido” universal

Este es probablemente el mito más extendido y peligroso. He visto estudiantes convencidos de que “hasta el 20% está bien” o que “si el detector marca menos de 15%, no pasa nada”. Esto es completamente falso.

¿Cuánta IA puedo usar en mi tesis?

- No existe un porcentaje universal establecido

- Cada universidad define sus propias políticas

- Lo relevante es el TIPO de uso, no la cantidad

- Un 5% de contenido delegado puede ser fraude; un 30% de uso asistido puede ser legítimo

La analogía que uso siempre: imagina que le pides a alguien que escriba tu tesis y luego le cambias algunas palabras. Técnicamente, el “porcentaje de plagio” podría ser bajo, pero el fraude es total. Lo mismo ocurre con la IA.

Desmontamos este mito en profundidad: La Verdad Oculta sobre el Porcentaje de IA Permitido en Tesis 2025.

Insight #2: Los detectores de IA tienen límites graves

Aquí viene otra verdad incómoda: Turnitin y otros detectores NO son infalibles. Las propias empresas que los desarrollan lo reconocen abiertamente.

El problema es triple: los falsos positivos hacen que textos escritos 100% por humanos se marquen como generados por IA; los textos mixtos producen resultados impredecibles; y la evolución constante de los modelos de IA supera la capacidad de adaptación de los detectores.

⚙️ Turnitin explica en su documentación técnica que los puntajes bajos pueden NO mostrarse en reportes, existen umbrales mínimos de detección, y las condiciones de análisis afectan los resultados.

⚠️ Turnitin reconoce en su artículo sobre falsos positivos que las métricas a nivel documento vs. oración difieren significativamente.

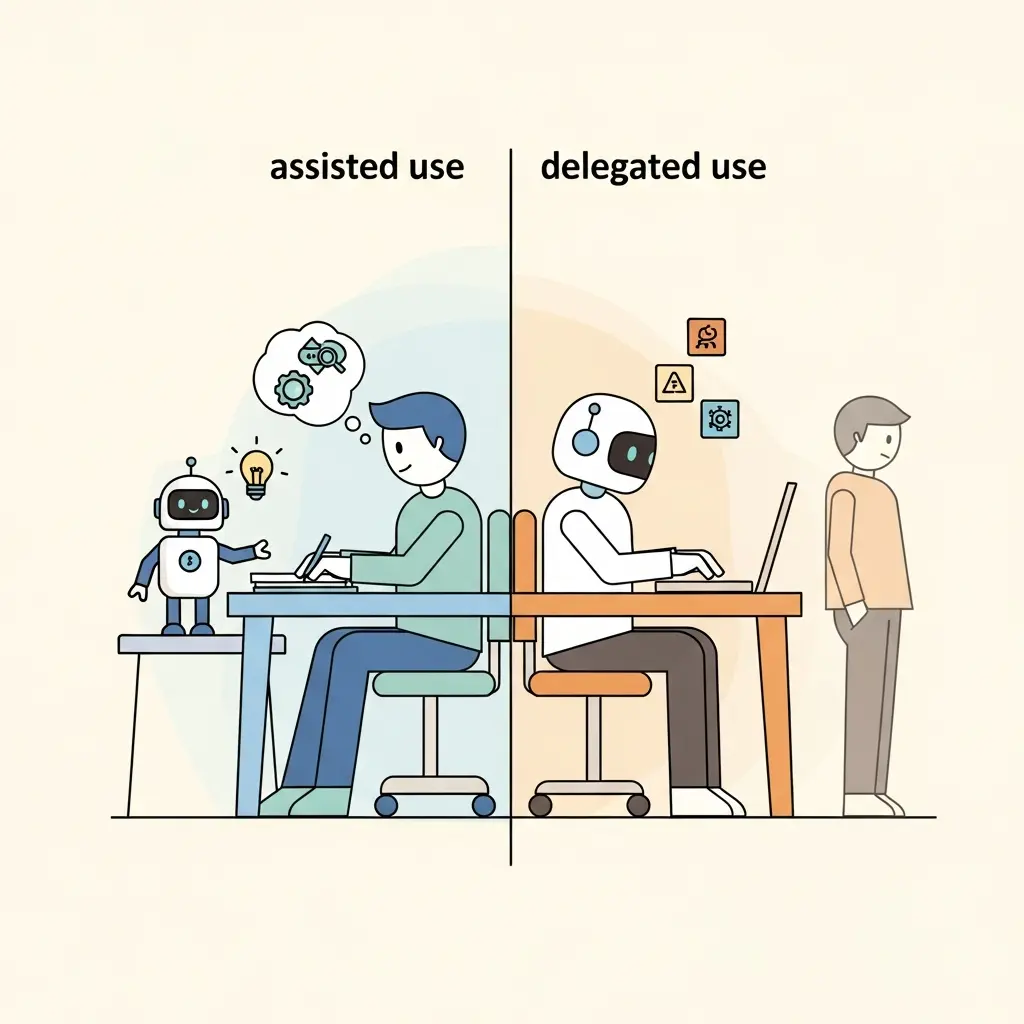

Insight #3: La diferencia entre “uso asistido” y “uso delegado” es TODO

Esta es la distinción más importante que debes entender. No todos los usos de IA son iguales:

| Uso Asistido ✓ | Uso Delegado ✗ |

|---|---|

| Corrección gramatical/ortográfica | Generación de argumentos principales |

| Sugerencias de estructura | Redacción de secciones completas |

| Reformulación de TUS ideas | Creación de conclusiones |

La regla de oro: si la IA piensa por ti, estás delegando. Si la IA mejora lo que tú pensaste, estás siendo asistido.

Insight #4: Tu mayor riesgo no es el detector, es no poder defender tu trabajo

Esto es lo que realmente me preocupa cuando hablo con estudiantes: están tan obsesionados con “pasar el detector” que olvidan algo fundamental. Vas a tener que defender tu tesis oralmente.

En esa defensa, el tribunal te hará preguntas sobre por qué elegiste determinada metodología, cómo llegaste a ciertas conclusiones, qué significan exactamente los conceptos que usas.

Si la IA escribió tu marco teórico, no vas a poder explicarlo con profundidad. Si ChatGPT generó tus conclusiones, no vas a entender realmente qué significan. Y créeme, los profesores lo notan en segundos.

He visto tribunales hacer una simple pregunta: “¿Podrías explicarme con tus propias palabras qué significa este párrafo que escribiste en la página 47?” Y el silencio del estudiante lo dice todo.

Insight #5: Las universidades están más perdidas que tú

Esta es quizás la verdad más frustrante: las instituciones no tienen las respuestas claras que esperas. Encontrarás políticas contradictorias entre departamentos, profesores con criterios diferentes, y zonas grises que te perjudican.

Esto no es para desanimarte, sino para que entiendas algo crucial: la responsabilidad de informarte y protegerte recae principalmente sobre ti.

Predicciones 2025-2026

Después de analizar las tendencias actuales y hablar con decenas de académicos, comparto mis predicciones sobre cómo evolucionarán los límites:

Declaración obligatoria universal: En los próximos meses veremos cómo la mayoría de universidades españolas implementan formularios estandarizados de uso de IA. No declararla cuando sí la uses será sancionable.

Evaluación del proceso: Las bitácoras digitales se convertirán en requisito. Los profesores querrán ver cómo llegaste al resultado final.

Competencias de “uso crítico de IA”: Saber usar IA de forma efectiva y ética se convertirá en una habilidad evaluable.

¿Cómo serán los límites para 2026?

Se espera un modelo de “transparencia obligatoria” donde el uso de IA no esté prohibido, pero sí sea requisito declarar exactamente cómo, cuándo y para qué se utilizó. El enfoque pasará de “detectar fraude” a “verificar aprendizaje”.

Guía Práctica Para Proteger Tu Tesis

Ahora viene lo que realmente necesitas: pasos concretos para protegerte mientras aprovechas las herramientas disponibles de forma ética.

![]()

Paso 1: Investiga la política de TU universidad. No te fíes de lo que escuchaste de un compañero. Busca el reglamento de TFG/TFM de tu facultad, la normativa de integridad académica, y las guías del departamento. Si no encuentras nada claro, pregunta por escrito a tu tutor y guarda la respuesta.

Paso 2: Documenta TODO tu proceso. Crea un archivo donde registres cada prompt que uses, las respuestas obtenidas, qué decidiste usar o descartar, y versiones de tu documento en diferentes momentos.

Paso 3: Usa IA como asistente, no como autor. Antes de incorporar cualquier contenido asistido por IA, pregúntate: “¿Podría defender esto en un tribunal de tesis sin ayuda?”

Paso 4: Declara proactivamente. Incluso si tu universidad no lo exige, incluye una sección de declaración de uso de IA en tu tesis. Demuestra integridad y te protege ante cualquier cuestionamiento.

Paso 5: Prepárate para defender cada palabra. Repasa todo haciéndote las preguntas típicas de un tribunal: ¿Por qué elegí esta metodología? ¿Qué significa exactamente este concepto? ¿Cómo se relaciona esta sección con mi objetivo?

5 pasos para usar IA sin riesgos:

- Consulta la política específica de tu universidad

- Documenta cada uso de IA (herramienta, prompt, resultado)

- Usa IA solo como asistente, nunca como autor

- Declara el uso proactivamente en tu trabajo

- Asegúrate de poder defender y explicar cada sección

¿Necesitas Ayuda Con Tu Tesis?

La incertidumbre sobre los límites del uso de inteligencia artificial te paraliza. Necesitas apoyo profesional que respete la integridad académica. Quieres maximizar tu tiempo sin arriesgar tu titulación.

Tesify es tu mejor aliado. Te ayudamos a navegar este panorama complejo con asesoría experta, herramientas éticas y el acompañamiento que necesitas para entregar un trabajo del que puedas sentirte orgulloso —y que puedas defender con total confianza.

Leave a Reply