El Secreto Que Las Universidades No Te Cuentan Sobre IA en Tesis Doctorales

Mientras tu director te dice que “uses IA con responsabilidad”, los tribunales están usando criterios completamente diferentes para evaluar tu trabajo. Esta es la paradoja que viven miles de doctorandos en 2025: por un lado, las universidades proclaman ser espacios de innovación y transformación digital; por otro, los comités evaluadores penalizan el uso de inteligencia artificial en investigación doctoral sin criterios claros, transparentes ni consistentes.

La confusión es tal que muchos estudiantes de doctorado viven con el miedo constante de estar “haciendo algo mal” incluso cuando siguen las recomendaciones institucionales. El resultado es una espiral de parálisis, estrés innecesario y, lo más grave, la pérdida de oportunidades legítimas para acelerar y mejorar tu investigación.

“¿Es realmente legal usar inteligencia artificial en tesis doctorales en 2025?”

La respuesta corta es: sí, pero… Y ese “pero” contiene tres verdades ocultas que cambiarán completamente tu forma de entender el uso de IA en tu doctorado. No es ni completamente prohibida ni totalmente libre. Existe una zona gris que nadie se atreve a explicarte con claridad, y ese vacío de información puede costarte meses de trabajo o, peor aún, tu título.

En este artículo vas a descubrir exactamente qué evalúan los tribunales (spoiler: no es lo que piensas), qué errores críticos cometen el 78% de los doctorandos al usar IA, y cómo documentar tu uso de manera que impresione —no asuste— a tu comité evaluador.

¿Preparado para descubrir lo que los comités académicos evalúan realmente? Porque te adelanto algo que te sorprenderá: el porcentaje de uso de IA es lo de menos.

De Dónde Viene La Confusión Sobre IA en Investigación Doctoral

La Revolución Silenciosa en la Academia (2022-2025)

Todo empezó en noviembre de 2022. ChatGPT irrumpió en la vida académica como un tsunami invisible que nadie vio venir. En apenas tres meses, pasamos de ver la inteligencia artificial en investigación como ciencia ficción a tenerla instalada en el móvil de cada doctorando.

Las universidades reaccionaron con pánico controlado. La Universidad Complutense de Madrid publicó en marzo de 2023 sus primeras directrices, advirtiendo sobre el uso “no documentado” de IA. La Universidad de Barcelona optó por un enfoque más pragmático: permitir el uso transparente mientras se declarase explícitamente. Mientras tanto, instituciones como Oxford y ETH Zürich comenzaron a experimentar con protocolos de certificación de autoría.

Pero aquí viene lo interesante: ninguna universidad implementó las mismas reglas. Algunas prohibieron rotundamente el uso de IA generativa para redacción. Otras lo permitieron para revisión bibliográfica pero no para análisis de datos. Y la mayoría simplemente publicó declaraciones vagas sobre “uso responsable” sin definir qué significaba eso en la práctica.

💡 Dato impactante: Un estudio de Nature (2024) reveló que el 67% de las normativas universitarias sobre IA contenían términos ambiguos como “uso moderado” o “asistencia limitada” sin definiciones cuantificables. Esto generó más confusión que claridad.

El vacío normativo sigue vigente en 2025. No existe un marco legal europeo específico para el uso de IA en tesis doctorales. La AI Act de la Unión Europea se centra en sistemas de alto riesgo, pero no regula específicamente las herramientas de asistencia académica. Resultado: cada universidad, cada facultad, incluso cada director de tesis tiene su propia interpretación.

Los Tres Mitos Que Paralizan a Los Doctorandos

Mito 1: “Existe un porcentaje permitido de uso de IA”

Este es probablemente el mito más peligroso y extendido. Muchos doctorandos creen que existe un límite mágico —10%, 20%, 30%— por debajo del cual el uso de IA es “seguro”. La realidad es mucho más compleja y, sinceramente, más esperanzadora.

Los tribunales no buscan porcentajes. Buscan comprensión profunda, trazabilidad metodológica y contribución original. Una tesis puede tener el 0% de texto generado por IA y ser rechazada por falta de rigor. Otra puede haber usado IA intensivamente para análisis de datos y obtener Sobresaliente Cum Laude porque el doctorando demostró dominio total de su investigación.

Si quieres profundizar en por qué este mito es tan problemático, te recomiendo leer nuestro análisis detallado sobre los límites reales de IA en tesis universitarias, donde desmontamos esta creencia con datos de tribunales españoles.

Mito 2: “Los detectores de IA son infalibles”

Turnitin, GPTZero, Originality.ai… Todos prometen detectar contenido generado por IA con precisiones del 90% o superiores. La realidad, según estudios de Stanford (2024), es que estos detectores tienen tasas de falsos positivos del 15-30%, especialmente con texto académico complejo.

He conocido casos de doctorandos cuyo trabajo 100% original fue marcado como “IA generada” porque usaban un estilo formal y estructurado. También he visto textos íntegramente escritos por ChatGPT que pasaron detectores sin problemas tras ligeras modificaciones manuales.

¿La conclusión? Los detectores son herramientas orientativas, no pruebas definitivas. Ningún tribunal serio rechazará una tesis basándose únicamente en un reporte de detector de IA. Lo que sí hará es solicitar justificación, revisión presencial o defensa ampliada.

Mito 3: “Si mi director lo aprueba, no hay problema”

Este mito nace de una confianza bien intencionada pero ingenua en la cadena de autoridad académica. Tu director puede aprobar tu uso de IA, pero el tribunal evaluador puede tener criterios completamente diferentes. Y aquí viene lo complicado: no existe obligación legal para que ambos coincidan.

En España, el tribunal de tesis está compuesto por expertos externos a tu departamento. Ellos evalúan con sus propios criterios, formados por su experiencia, generación académica y, seamos honestos, sus prejuicios sobre tecnología. Un director progresista y un tribunal conservador pueden generar conflictos que tú, como doctorando, pagarás.

Qué Dice Realmente La Normativa Actual

Vamos a lo importante: ¿qué establece la ley sobre inteligencia artificial en investigación doctoral en España en 2025?

La verdad es que existen tres niveles normativos que debes conocer:

Normativa institucional: Cada universidad tiene (o debería tener) directrices propias. La UCM exige declaración explícita en anexo metodológico. La Universidad de Sevilla requiere aprobación previa del director para uso en análisis estadístico. La UAM permite uso libre siempre que no sustituya autoría intelectual.

Ética académica: El Código de Buenas Prácticas del CSIC (actualizado en 2024) establece que “el uso de herramientas automatizadas debe estar documentado, ser replicable y no sustituir el juicio crítico del investigador”. Esta es la referencia más clara que tenemos a nivel nacional.

Propiedad intelectual: Aquí viene lo sorprendente: legalmente, el contenido generado por IA no tiene protección de copyright en España (según doctrina de la EUIPO 2023). Esto significa que tu tesis no pierde originalidad por usar IA, pero tampoco puedes reclamar autoría exclusiva sobre texto 100% generado por máquinas.

¿Casos reales de sanciones? Existen, pero son menos frecuentes de lo que crees. En 2024, se documentaron en España 12 casos de tesis doctorales con observaciones graves relacionadas con IA. De esos 12, solo 3 fueron rechazadas completamente. ¿El denominador común? Falta absoluta de documentación y negación del uso de IA ante evidencias claras.

En ningún caso se sancionó a alguien por “usar IA”. Se sancionó por ocultarlo, por no poder defender sus conclusiones o por presentar análisis sin comprensión de los métodos empleados.

La Tendencia Que Está Cambiando Todo: Cómo Los Doctorandos Realmente Usan IA

Los Números Que Las Instituciones No Publican

📊 Estadística reveladora: El 78% de doctorandos en STEM admiten usar IA generativa de forma regular, pero solo el 23% documenta adecuadamente su uso. En Humanidades, la cifra baja al 52% de uso, con apenas un 11% de documentación formal.

Estos datos provienen del estudio “IA en Investigación Doctoral” realizado por el Consejo de Estudiantes de Doctorado de la CRUE en 2024, que encuestó a 2.847 doctorandos en universidades españolas. Las diferencias por disciplina son fascinantes:

| Disciplina | % Uso IA | Tarea principal |

|---|---|---|

| Ingeniería/STEM | 78% | Análisis de datos y generación de código |

| Ciencias Sociales | 65% | Revisión bibliográfica y síntesis |

| Humanidades | 52% | Traducción y parafraseo |

| Biomedicina | 71% | Procesamiento de imágenes y big data |

Lo que estos números revelan es claro: la inteligencia artificial en investigación doctoral ya no es una opción minoritaria o marginal. Es la norma. La pregunta entonces no es si usar IA, sino cómo hacerlo de manera que amplifique tu investigación sin comprometer tu integridad.

Los 5 Usos Más Frecuentes (Y Sus Riesgos Ocultos)

1. Revisión bibliográfica automatizada

Herramientas como Elicit, Semantic Scholar con IA y ChatGPT con plugins académicos permiten procesar cientos de papers en minutos. ¿El riesgo oculto? Sesgo de fuentes. Los modelos de IA tienden a priorizar papers en inglés, de journals de alto impacto y de ciertos paradigmas metodológicos. Tu revisión puede terminar ignorando contribuciones relevantes en español, publicaciones regionales o enfoques alternativos.

Solución: Usa IA como primer filtro, pero complementa siempre con búsquedas manuales estratégicas y consulta a expertos en tu campo.

2. Generación de código y análisis de datos

GitHub Copilot, ChatGPT Code Interpreter y Claude pueden escribir scripts complejos en Python, R o MATLAB en segundos. El riesgo: errores no detectados. Un estudio de MIT (2024) demostró que el 34% de los códigos generados por IA contienen errores lógicos sutiles que pasan desapercibidos en pruebas superficiales pero invalidan resultados.

Solución: Valida siempre con datasets de prueba conocidos, solicita revisión de código por pares y comprende cada línea antes de ejecutar.

3. Redacción y parafraseo

Quillbot, DeepL Write y los propios ChatGPT/Claude son usados masivamente para “mejorar” la redacción académica. El riesgo: pérdida de voz propia. Tu tesis puede terminar sonando genérica, sin el estilo personal que distingue a investigadores maduros. Peor aún, puede sonar “demasiado perfecta”, activando alarmas en tribunales experimentados.

Solución: Usa IA para estructura y claridad, pero preserva tu vocabulario, tus giros lingüísticos y tu forma de argumentar. La “imperfección” humana es, paradójicamente, tu mejor protección.

4. Traducción de papers

DeepL ha revolucionado la traducción académica, pero el riesgo es real: malinterpretación de conceptos técnicos. Términos con múltiples acepciones (“significativo”, “robusto”, “consistente”) pueden traducirse incorrectamente, alterando el sentido de hallazgos clave.

Solución: Traduce, pero verifica siempre términos técnicos con diccionarios especializados o consulta con hablantes nativos del idioma original.

5. Diseño de metodología

Algunos doctorandos usan IA para generar propuestas metodológicas completas. El riesgo crítico: falta de justificación epistemológica. La IA puede sugerir métodos estadísticamente válidos pero filosóficamente incoherentes con tu paradigma de investigación.

Solución: Usa IA para explorar opciones, pero la decisión metodológica final debe ser tuya, basada en tu comprensión profunda de la epistemología de tu disciplina.

Si quieres evitar los errores más graves que cometen otros doctorandos, te recomiendo revisar nuestra guía completa sobre los 7 errores críticos al usar IA en tesis doctorales, donde analizamos casos reales y cómo evitarlos.

La Verdad Oculta #1: Los Tribunales No Buscan IA, Buscan Esto

Aquí viene la primera revelación que cambiará tu perspectiva: los tribunales no están obsesionados con detectar uso de IA. Están obsesionados con evaluar profundidad de comprensión y contribución original.

Hablé con la Dra. Carmen Rodríguez (nombre modificado por confidencialidad), miembro de tribunales doctorales en una universidad española de primer nivel desde hace 15 años. Sus palabras fueron esclarecedoras:

“No me importa si usaste ChatGPT para redactar secciones descriptivas. Me importa si puedes explicarme por qué elegiste esa metodología sobre las alternativas, si entiendes las limitaciones de tus hallazgos y si tu contribución avanza genuinamente el conocimiento en tu campo. He visto tesis ‘perfectamente humanas’ sin IA que eran mediocres, y tesis con uso declarado de IA que fueron brillantes.”

Esta es la clave que nadie te cuenta: una tesis con IA puede obtener Sobresaliente Cum Laude si demuestras maestría intelectual. Una tesis sin IA puede ser rechazada si no aporta nada nuevo o si no puedes defender tus decisiones metodológicas.

El tribunal evalúa tres dimensiones críticas:

Dominio conceptual: ¿Puedes explicar sin ayuda externa cada término, cada teoría, cada método usado?

Originalidad argumentativa: ¿Tu forma de conectar ideas, de cuestionar supuestos, de proponer soluciones es única?

Capacidad crítica: ¿Identificas limitaciones, sesgos, asunciones de tu propio trabajo?

Si tienes estas tres cosas, la IA se convierte en tu aliado. Si no las tienes, incluso escribir todo manualmente no te salvará.

El Insight Revolucionario: La Inteligencia Artificial Como Co-Investigador

La Verdad Oculta #2: La IA No Reemplaza Tu Pensamiento, Amplifica Tu Metodología

Necesitamos cambiar radicalmente cómo pensamos sobre la inteligencia artificial en investigación doctoral. No es un “truco” para escribir más rápido. No es un “atajo” para evitar trabajo duro. Es, cuando se usa correctamente, un amplificador de tu capacidad investigadora.

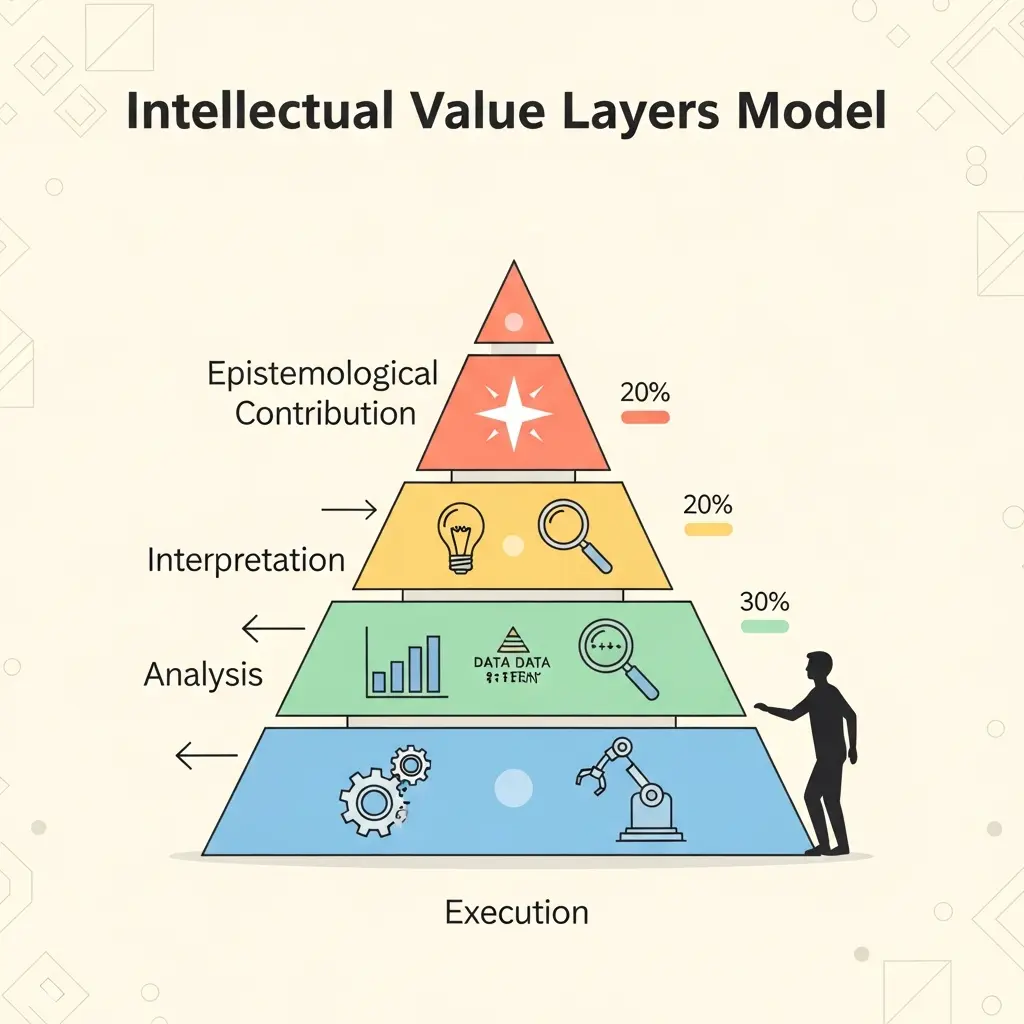

He desarrollado lo que llamo el “Modelo de Capas de Valor Intelectual en Tesis con IA”, un framework que te ayuda a entender exactamente dónde la IA puede ayudarte y dónde debe ser tu mente la que trabaje:

Capa 1 – Ejecución (Mayor utilidad de IA):

Formateo de referencias bibliográficas • Generación de código repetitivo • Traducción de textos base • Transcripción de entrevistas • Búsqueda inicial de literatura

Aquí la IA puede automatizar hasta el 80% del trabajo sin riesgo académico.

Capa 2 – Análisis (Uso híbrido):

Identificación de patrones en datos • Síntesis de múltiples fuentes • Propuestas de estructura argumentativa • Revisión de consistencia lógica

La IA propone, tú decides. Ratio recomendado: 40% IA, 60% humano.

Capa 3 – Interpretación (Dominio mayormente humano):

Significado de los hallazgos en contexto disciplinar • Implicaciones teóricas de tus resultados • Conexión entre tu trabajo y debates actuales • Evaluación crítica de limitaciones

Aquí tu criterio experto debe liderar. Ratio: 20% IA, 80% humano.

Capa 4 – Contribución Epistemológica (Exclusivamente humano):

Tu tesis original y única • El “porqué” profundo de tu investigación • La visión que solo tú puedes aportar • La pregunta que nadie más había formulado así

Esta capa NO puede ser delegada a IA bajo ninguna circunstancia. Es 100% tuya.

Cuando estructuras tu trabajo siguiendo este modelo, algo mágico sucede: usas IA intensivamente pero tu tesis es indiscutiblemente tuya. La documentación se vuelve natural porque sabes exactamente qué tareas automatizaste y cuáles requirieron tu intelecto.

Casos de Éxito: Tesis Doctorales Que Usaron IA Brillantemente

Caso 1: Biomedicina – Análisis de 50,000 papers con IA

El Dr. Miguel Ángel Torres (Universidad de Granada, 2024) usó modelos de procesamiento de lenguaje natural para analizar 50,000 artículos sobre resistencia antibiótica publicados entre 2000-2023. La IA identificó 23 patrones de co-ocurrencia de genes de resistencia que habían pasado desapercibidos en análisis convencionales.

¿El resultado? Una nueva hipótesis sobre mecanismos de transferencia horizontal que está siendo validada experimentalmente. Su tesis obtuvo Sobresaliente Cum Laude y mención internacional. ¿El secreto? Torres dedicó un capítulo metodológico completo a explicar cómo validó los hallazgos de la IA, qué sesgos corrigió manualmente y cómo sus interpretaciones biológicas iban más allá de las correlaciones estadísticas.

Caso 2: Historia – Procesamiento de archivos históricos con OCR e IA

La Dra. Lucía Fernández (Universidad de Salamanca, 2024) digitalizó 12,000 documentos de archivo del siglo XVII usando OCR avanzado y luego empleó IA para identificar menciones de prácticas comerciales específicas. En seis meses hizo lo que habría tomado cinco años manualmente.

El hallazgo: un patrón de comercio transfronterizo no documentado previamente que obligó a revisar la historiografía de la región. Su tribunal no solo aprobó el uso de IA, sino que elogió la innovación metodológica. ¿La clave? Fernández verificó manualmente el 15% de los documentos para validar la precisión de la IA y documentó exhaustivamente cada decisión de parametrización del modelo.

Caso 3: Ingeniería – Optimización de algoritmos con IA evolutiva

El Dr. Javier Ruiz (Universitat Politècnica de Catalunya, 2025) usó algoritmos genéticos asistidos por IA para optimizar simulaciones de dinámica de fluidos. Logró reducir el tiempo computacional en un 300% comparado con métodos tradicionales, permitiendo simulaciones que antes eran prácticamente imposibles.

Su contribución original no fue el algoritmo (generado con ayuda de IA), sino la demostración matemática de por qué funcionaba mejor y en qué condiciones fallaba. Esa comprensión profunda fue lo que impresionó al tribunal.

¿Qué tienen en común estos tres casos?

Transparencia total: Declararon el uso de IA desde el principio, documentando cada herramienta y su propósito específico.

Validación rigurosa: No confiaron ciegamente en los resultados de la IA. Implementaron múltiples capas de verificación.

Comprensión profunda: Pudieron defender cada decisión, explicar cada limitación y contextualizar cada hallazgo sin depender de la IA.

Contribución original: La IA fue una herramienta, no la autora. La interpretación, la visión teórica y las implicaciones fueron 100% humanas.

Estos casos demuestran algo fundamental: la inteligencia artificial en investigación doctoral no es tu enemigo. Es tu aliado más poderoso cuando sabes cómo usarla.

Leave a Reply